–ù–Α–¥–Ω―Ä–Β–≤–Α―Ä–Α―²–Α –≤―ä–≤ –≤―ä–Ψ―Ä―ä–Ε–Α–≤–Α–Ϋ–Β―²–Ψ –Φ–Β–Ε–¥―É –¥–Η–Ι–Ω―³–Β–Ι–Κ –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η―è―²–Α ―¹ –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ –Η–Ϋ―²–Β–Μ–Β–Κ―² (AI) –Η –Φ–Β―²–Ψ–¥–Η―²–Β, –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α–Ϋ–Η –Ζ–Α ―²―è―Ö–Ϋ–Ψ―²–Ψ –Ψ―²–Κ―Ä–Η–≤–Α–Ϋ–Β, ―¹―²–Α–≤–Α –≤―¹–Β –Ω–Ψ-–Ψ–Ε–Β―¹―²–Ψ―΅–Β–Ϋ–Α.

–ù–Α–Ι-–Ϋ–Ψ–≤–Η―è―² –Ω―Ä–Ψ–≥―Ä–Β―¹ –≤ –Ψ–±–Μ–Α―¹―²―²–Α –Ϋ–Α ―Ä–Α–Ζ–Κ―Ä–Η–≤–Α–Ϋ–Β―²–Ψ –Η–¥–≤–Α –Ψ―² –Α―¹―²―Ä–Ψ–Ϋ–Ψ–Φ–Η―è―²–Α. –Γ–Μ–Ψ–Ε–Ϋ–Η―²–Β –Φ–Β―²–Ψ–¥–Η, –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α–Ϋ–Η –Ζ–Α –Α–Ϋ–Α–Μ–Η–Ζ –Η ―²―ä–Μ–Κ―É–≤–Α–Ϋ–Β –Ϋ–Α ―¹–≤–Β―²–Μ–Η–Ϋ–Α―²–Α –≤ –Α―¹―²―Ä–Ψ–Ϋ–Ψ–Φ–Η―΅–Β―¹–Κ–Η―²–Β –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η―è, –Φ–Ψ–≥–Α―² –¥–Α –±―ä–¥–Α―² –Ω―Ä–Η–Μ–Ψ–Ε–Β–Ϋ–Η –Ω―Ä–Η ―Ä–Α–Ζ–Κ―Ä–Η–≤–Α–Ϋ–Β―²–Ψ –Ϋ–Α ―³–Α–Μ―à–Η―³–Η–Κ–Α―²–Η.

–î―É–Φ–Α―²–Α "–¥–Η–Ι–Ω―³–Β–Ι–Κ" –Β¬†–Κ–Ψ–Φ–±–Η–Ϋ–Α―Ü–Η―è –Ψ―² "–¥―ä–Μ–±–Ψ–Κ–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β" –Η "―³–Α–Μ―à–Η―³–Η–Κ–Α―²–Η" (βĉdeepfakesβÄô = βĉdeep learningβÄô + βĉfakes).

–Δ–Β–Ζ–Η ―³–Α–Μ―à–Η–≤–Η –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η―è ―¹–Β –Ϋ–Α―Ä–Η―΅–Α―² ―²–Α–Κ–Α, –Ζ–Α―â–Ψ―²–Ψ ―¹–Α ―¹―ä–Ζ–¥–Α–¥–Β–Ϋ–Η ―¹ –Ω–Ψ–Φ–Ψ―â―²–Α –Ϋ–Α –Ψ–Ω―Ä–Β–¥–Β–Μ–Β–Ϋ –≤–Η–¥ –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ –Η–Ϋ―²–Β–Μ–Β–Κ―², –Ϋ–Α―Ä–Β―΅–Β–Ϋ –¥―ä–Μ–±–Ψ–Κ–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β (–≤–Ε "–ö–Α–Κ ―Ä–Α–±–Ψ―²–Η –¥―ä–Μ–±–Ψ–Κ–Ψ―²–Ψ ―¹–Α–Φ–Ψ–Ψ–±―É―΅–Β–Ϋ–Η–Β –Ϋ–Α –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Η―²–Β –Φ―Ä–Β–Ε–Η?"), –Κ–Ψ–Β―²–Ψ ―¹–Α–Φ–Ψ –Ω–Ψ ―¹–Β–±–Β ―¹–Η –Β –Ω–Ψ–¥–≤–Η–¥ –Ϋ–Α –Φ–Α―à–Η–Ϋ–Ϋ–Ψ―²–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β. AI ―¹ –¥―ä–Μ–±–Ψ–Κ–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β –Φ–Ψ–Ε–Β –¥–Α –Η–Φ–Η―²–Η―Ä–Α –Ϋ–Β―â–Ψ –¥–Ψ―¹―²–Α –¥–Ψ–±―Ä–Β, ―¹–Μ–Β–¥ –Κ–Α―²–Ψ –Φ―É –±―ä–¥–Α―² –Ω–Ψ–Κ–Α–Ζ–Α–Ϋ–Η –Φ–Ϋ–Ψ–≥–Ψ –Ω―Ä–Η–Φ–Β―Ä–Η –Ζ–Α ―²–Ψ–≤–Α, –Κ–Ψ–Β―²–Ψ ―¹–Β –Η―¹–Κ–Α –¥–Α ―³–Α–Μ―à–Η―³–Η―Ü–Η―Ä–Α. –ö–Ψ–≥–Α―²–Ψ ―¹―²–Α–≤–Α –≤―ä–Ω―Ä–Ψ―¹ –Ζ–Α –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η―è, –¥–Η–Ι–Ω―³–Β–Ι–Κ–Ψ–≤–Β―²–Β –Ψ–±–Η–Κ–Ϋ–Ψ–≤–Β–Ϋ–Ψ –≤–Κ–Μ―é―΅–≤–Α―² –Ζ–Α–Φ―è–Ϋ–Α –Ϋ–Α ―¹―ä―â–Β―¹―²–≤―É–≤–Α―â–Ψ―²–Ψ –Μ–Η―Ü–Β –≤ –¥–Α–¥–Β–Ϋ–Ψ –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η–Β ―¹ –Μ–Η―Ü–Β –Ϋ–Α –¥―Ä―É–≥ ―΅–Ψ–≤–Β–Κ, –Ζ–Α –¥–Α –Η–Ζ–≥–Μ–Β–Ε–¥–Α, ―΅–Β –Ϋ―è–Κ–Ψ–Ι –¥―Ä―É–≥ –Β –Ϋ–Α –Ψ–Ω―Ä–Β–¥–Β–Μ–Β–Ϋ–Ψ –Φ―è―¹―²–Ψ, –≤ –Κ–Ψ–Φ–Ω–Α–Ϋ–Η―è―²–Α –Ϋ–Α –Ψ–Ω―Ä–Β–¥–Β–Μ–Β–Ϋ–Η ―Ö–Ψ―Ä–Α –Η–Μ–Η ―É―΅–Α―¹―²–≤–Α –≤ –Ψ–Ω―Ä–Β–¥–Β–Μ–Β–Ϋ–Η –¥–Β–Ι–Ϋ–Ψ―¹―²–Η.

–î–Η–Ι–Ω―³–Β–Ι–Κ–Ψ–≤–Β―²–Β ―¹―²–Α–≤–Α―² –≤―¹–Β –Ω–Ψ-–¥–Ψ–±―Ä–Η –Η –Ω–Ψ-–¥–Ψ–±―Ä–Η, –Κ–Α–Κ―²–Ψ –Η –¥―Ä―É–≥–Η―²–Β ―³–Ψ―Ä–Φ–Η –Ϋ–Α –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ –Η–Ϋ―²–Β–Μ–Β–Κ―². –ù–Ψ –Κ–Α–Κ―²–Ψ ―¹–Β –Ψ–Κ–Α–Ζ–≤–Α, –Ϋ–Ψ–≤ –Η–Ϋ―¹―²―Ä―É–Φ–Β–Ϋ―² –Ζ–Α ―Ä–Α–Ζ–Κ―Ä–Η–≤–Α–Ϋ–Β –Ϋ–Α –¥–Η–Ι–Ω―³–Β–Ι–Κ–Ψ–≤–Β –≤–Β―΅–Β ―¹―ä―â–Β―¹―²–≤―É–≤–Α –≤ –Α―¹―²―Ä–Ψ–Ϋ–Ψ–Φ–Η―è―²–Α. –ê―¹―²―Ä–Ψ–Ϋ–Ψ–Φ–Η―è―²–Α –Β ―¹–≤―ä―Ä–Ζ–Α–Ϋ–Α ―¹―ä―¹ ―¹–≤–Β―²–Μ–Η–Ϋ–Α―²–Α, –Α –Ϋ–Α―É–Κ–Α―²–Α –Ζ–Α –Ψ―²–Κ―Ä–Η–≤–Α–Ϋ–Β –Ϋ–Α –Ϋ–Α–Ι-–Φ–Α–Μ–Κ–Η―²–Β –¥–Β―²–Α–Ι–Μ–Η –≤ ―¹–≤–Β―²–Μ–Η–Ϋ–Α―²–Α –Ψ―² –Η–Ζ–Κ–Μ―é―΅–Η―²–Β–Μ–Ϋ–Ψ –¥–Α–Μ–Β―΅–Ϋ–Η –Η ―¹–Μ–Ψ–Ε–Ϋ–Η –Ψ–±–Β–Κ―²–Η ―¹–Β ―Ä–Α–Ζ–≤–Η–≤–Α ―¹―ä―â–Ψ ―²–Ψ–Μ–Κ–Ψ–≤–Α –±―ä―Ä–Ζ–Ψ, –Κ–Ψ–Μ–Κ–Ψ―²–Ψ –Η –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Η―è―² –Η–Ϋ―²–Β–Μ–Β–Κ―².

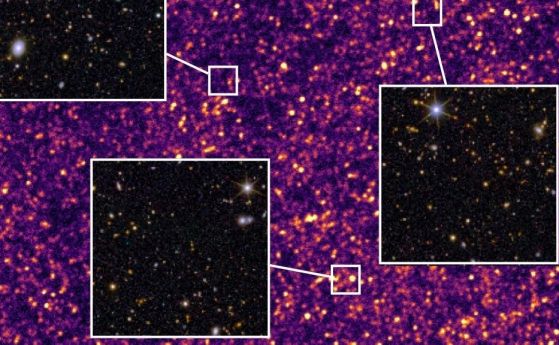

–£ –Ϋ–Ψ–≤–Α ―¹―²–Α―²–Η―è –≤ Nature –Ϋ–Α―É―΅–Ϋ–Η―è―² –Ε―É―Ä–Ϋ–Α–Μ–Η―¹―² –Γ–Α―Ä–Α –Θ–Α–Ι–Μ–¥ (Sarah Wild) ―Ä–Α–Ζ–≥–Μ–Β–Ε–¥–Α –Κ–Α–Κ –Η–Ζ―¹–Μ–Β–¥–Ψ–≤–Α―²–Β–Μ–Η―²–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α―² –Α―¹―²―Ä–Ψ–Ϋ–Ψ–Φ–Η―΅–Β―¹–Κ–Η –Φ–Β―²–Ψ–¥–Η –Ζ–Α ―Ä–Α–Ζ–Κ―Ä–Η–≤–Α–Ϋ–Β –Ϋ–Α –¥―ä–Μ–±–Ψ–Κ–Η ―³–Α–Μ―à–Η―³–Η–Κ–Α―²–Η. –ê–¥–Β–Ε―É–Φ–Ψ–Κ–Β –û–≤–Ψ–Μ–Α–±–Η (Adejumoke Owolabi) –Β ―¹―²―É–¥–Β–Ϋ―²–Κ–Α –≤ –Θ–Ϋ–Η–≤–Β―Ä―¹–Η―²–Β―²–Α –Ξ―ä–Μ –≤―ä–≤ –£–Β–Μ–Η–Κ–Ψ–±―Ä–Η―²–Α–Ϋ–Η―è, –Κ–Ψ―è―²–Ψ –Η–Ζ―É―΅–Α–≤–Α –Ϋ–Α―É–Κ–Α –Ζ–Α –¥–Α–Ϋ–Ϋ–Η―²–Β –Η –Κ–Ψ–Φ–Ω―é―²―ä―Ä–Ϋ–Α –≤–Η–Ζ―É–Α–Μ–Η–Ζ–Α―Ü–Η―è. –ù–Β–Ι–Ϋ–Α―²–Α –Φ–Α–≥–Η―¹―²―ä―Ä―¹–Κ–Α ―²–Β–Ζ–Α ―¹–Β ―³–Ψ–Κ―É―¹–Η―Ä–Α –≤―ä―Ä―Ö―É ―²–Ψ–≤–Α –Κ–Α–Κ ―¹–≤–Β―²–Μ–Η–Ϋ–Α―²–Α, –Ψ―²―Ä–Α–Ζ–Β–Ϋ–Α –≤ –Ψ―΅–Ϋ–Η―²–Β ―è–±―ä–Μ–Κ–Η, ―²―Ä―è–±–≤–Α –¥–Α –±―ä–¥–Β –Ω–Ψ―¹–Μ–Β–¥–Ψ–≤–Α―²–Β–Μ–Ϋ–Α, –Φ–Α–Κ–Α―Ä –Η –Ϋ–Β –Η–¥–Β–Ϋ―²–Η―΅–Ϋ–Α, –Φ–Β–Ε–¥―É –Μ―è–≤–Α―²–Α –Η –¥―è―¹–Ϋ–Α―²–Α ―¹―²―Ä–Α–Ϋ–Α. –û–≤–Ψ–Μ–Α–±–Η –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –≤–Η―¹–Ψ–Κ–Ψ–Κ–Α―΅–Β―¹―²–≤–Β–Ϋ –Ϋ–Α–±–Ψ―Ä –Ψ―² –¥–Α–Ϋ–Ϋ–Η –Ζ–Α ―΅–Ψ–≤–Β―à–Κ–Η –Μ–Η―Ü–Α –Ψ―² Flickr –Η ―¹–Μ–Β–¥ ―²–Ψ–≤–Α –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –≥–Β–Ϋ–Β―Ä–Α―²–Ψ―Ä –Ϋ–Α –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η―è, –Ζ–Α –¥–Α ―¹―ä–Ζ–¥–Α–¥–Β ―³–Α–Μ―à–Η–≤–Η –Μ–Η―Ü–Α. –Γ–Μ–Β–¥ ―²–Ψ–≤–Α –≥–Η ―¹―Ä–Α–≤–Ϋ―è–≤–Α ―¹ –Ω–Ψ–Φ–Ψ―â―²–Α –Ϋ–Α –¥–≤–Β ―Ä–Α–Ζ–Μ–Η―΅–Ϋ–Η –Α―¹―²―Ä–Ψ–Ϋ–Ψ–Φ–Η―΅–Β―¹–Κ–Η ―¹–Η―¹―²–Β–Φ–Η –Ζ–Α –Η–Ζ–Φ–Β―Ä–≤–Α–Ϋ–Β, –Ϋ–Α―Ä–Β―΅–Β–Ϋ–Η ―¹–Η―¹―²–Β–Φ–Α CAS –Η –Η–Ϋ–¥–Β–Κ―¹ –Ϋ–Α –î–Ε–Η–Ϋ–Η (Gini index), –Ζ–Α –¥–Α ―¹―Ä–Α–≤–Ϋ–Η ―¹–≤–Β―²–Μ–Η–Ϋ–Α―²–Α, –Ψ―²―Ä–Α–Ζ–Β–Ϋ–Α –≤ –Ψ―΅–Ϋ–Η―²–Β ―è–±―ä–Μ–Κ–Η, –Η –¥–Α –Ψ–Ω―Ä–Β–¥–Β–Μ–Η –Κ–Ψ–Η ―¹–Α –¥–Η–Ι–Ω―³–Β–Ι–Κ–Ψ–≤–Β.

CAS –Ψ–Ζ–Ϋ–Α―΅–Α–≤–Α –Κ–Ψ–Ϋ―Ü–Β–Ϋ―²―Ä–Α―Ü–Η―è, –Α―¹–Η–Φ–Β―²―Ä–Η―è –Η –≥–Μ–Α–¥–Κ–Ψ―¹―² (concentration, asymmetry, and smoothness) –Η –Α―¹―²―Ä–Ψ–Ϋ–Ψ–Φ–Η―²–Β ―è –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α―² –Ψ―² –¥–Β―¹–Β―²–Η–Μ–Β―²–Η―è, –Ζ–Α –¥–Α –Η–Ζ―É―΅–Α–≤–Α―² –Η –Ψ–Ω―Ä–Β–¥–Β–Μ―è―² –Κ–Ψ–Μ–Η―΅–Β―¹―²–≤–Β–Ϋ–Ψ ―¹–≤–Β―²–Μ–Η–Ϋ–Α―²–Α –Ψ―² –Η–Ζ–≤―ä–Ϋ–≥–Α–Μ–Α–Κ―²–Η―΅–Β―¹–Κ–Η –Ζ–≤–Β–Ζ–¥–Η. –Δ–Ψ–Ι ―¹–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –Η –Ζ–Α –Κ–Ψ–Μ–Η―΅–Β―¹―²–≤–Β–Ϋ–Ψ –Ψ–Ω―Ä–Β–¥–Β–Μ―è–Ϋ–Β –Ϋ–Α ―¹–≤–Β―²–Μ–Η–Ϋ–Α―²–Α –Ψ―² ―Ü–Β–Μ–Η –≥–Α–Μ–Α–Κ―²–Η–Κ–Η –Η ―¹–Η –Ω―Ä–Ψ–Ω―Ä–Α–≤―è –Ω―ä―² –≤ –±–Η–Ψ–Μ–Ψ–≥–Η―è―²–Α –Η –¥―Ä―É–≥–Η –Ψ–±–Μ–Α―¹―²–Η, –Κ―ä–¥–Β―²–Ψ –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η―è―²–Α ―²―Ä―è–±–≤–Α –¥–Α –±―ä–¥–Α―² –≤–Ϋ–Η–Φ–Α―²–Β–Μ–Ϋ–Ψ –Η–Ζ―¹–Μ–Β–¥–≤–Α–Ϋ–Η. –‰–Ζ–≤–Β―¹―²–Ϋ–Η―è―² –Α―¹―²―Ä–Ψ―³–Η–Ζ–Η–Κ –ö―Ä–Η―¹―²–Ψ―³―ä―Ä –ö–Ψ–Ϋ―¹–Β–Μ–Η―¹ (Christopher Conselice) –Β –Ψ―¹–Ϋ–Ψ–≤–Β–Ϋ –Ω―Ä–Η–≤―ä―Ä–Ε–Β–Ϋ–Η–Κ –Ϋ–Α –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α–Ϋ–Β―²–Ψ –Ϋ–Α CAS –≤ –Α―¹―²―Ä–Ψ–Ϋ–Ψ–Φ–Η―è―²–Α.

–‰–Ϋ–¥–Β–Κ―¹―ä―² –Ϋ–Α –î–Ε–Η–Ϋ–Η, –Η–Μ–Η –Κ–Ψ–Β―³–Η―Ü–Η–Β–Ϋ―²―ä―² –Ϋ–Α –î–Ε–Η–Ϋ–Η, ―¹―ä―â–Ψ ―¹–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –Ζ–Α –Η–Ζ―¹–Μ–Β–¥–≤–Α–Ϋ–Β –Ϋ–Α –≥–Α–Μ–Α–Κ―²–Η–Κ–Η―²–Β. –ù–Α―Ä–Β―΅–Β–Ϋ –Β –Ϋ–Α –Η–Φ–Β―²–Ψ –Ϋ–Α –Η―²–Α–Μ–Η–Α–Ϋ―¹–Κ–Η―è ―¹―²–Α―²–Η―¹―²–Η–Κ –ö–Ψ―Ä–Α–¥–Ψ –î–Ε–Η–Ϋ–Η, –Κ–Ψ–Ι―²–Ψ –≥–Ψ ―Ä–Α–Ζ―Ä–Α–±–Ψ―²–≤–Α –Ω―Ä–Β–Ζ 1912 –≥. –Ζ–Α –Η–Ζ–Φ–Β―Ä–≤–Α–Ϋ–Β –Ϋ–Α –Ϋ–Β―Ä–Α–≤–Β–Ϋ―¹―²–≤–Ψ―²–Ψ –≤ –¥–Ψ―Ö–Ψ–¥–Η―²–Β. –ê―¹―²―Ä–Ψ–Ϋ–Ψ–Φ–Η―²–Β –≥–Ψ –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α―², –Ζ–Α –¥–Α –Η–Ζ–Φ–Β―Ä―è―² –Κ–Α–Κ ―¹–Β ―Ä–Α–Ζ–Ω―Ä–Ψ―¹―²―Ä–Α–Ϋ―è–≤–Α ―¹–≤–Β―²–Μ–Η–Ϋ–Α―²–Α –≤ –≥–Α–Μ–Α–Κ―²–Η–Κ–Α―²–Α –Η –¥–Α–Μ–Η ―²―è –Β ―Ä–Α–≤–Ϋ–Ψ–Φ–Β―Ä–Ϋ–Α –Η–Μ–Η –Κ–Ψ–Ϋ―Ü–Β–Ϋ―²―Ä–Η―Ä–Α–Ϋ–Α. –Δ–Ψ–≤–Α –Β –Η–Ϋ―¹―²―Ä―É–Φ–Β–Ϋ―², –Κ–Ψ–Ι―²–Ψ –Ω–Ψ–Φ–Α–≥–Α –Ϋ–Α –Α―¹―²―Ä–Ψ–Ϋ–Ψ–Φ–Η―²–Β –¥–Α –Ψ–Ω―Ä–Β–¥–Β–Μ―è―² –Φ–Ψ―Ä―³–Ψ–Μ–Ψ–≥–Η―è―²–Α –Η –Κ–Μ–Α―¹–Η―³–Η–Κ–Α―Ü–Η―è―²–Α –Ϋ–Α –¥–Α–¥–Β–Ϋ–Α –≥–Α–Μ–Α–Κ―²–Η–Κ–Α.

–£ ―¹–≤–Ψ–Β―²–Ψ –Η–Ζ―¹–Μ–Β–¥–≤–Α–Ϋ–Β –û–≤–Ψ–Μ–Α–±–Η ―É―¹–Ω–Β―à–Ϋ–Ψ –Ψ–Ω―Ä–Β–¥–Β–Μ―è –Κ–Ψ–Η –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η―è ―¹–Α ―³–Α–Μ―à–Η–≤–Η –≤ 70% –Ψ―² ―¹–Μ―É―΅–Α–Η―²–Β.

–£―¹–Η―΅–Κ–Η ―²–Β–Ζ–Η –Ψ―΅–Η ―¹–Α –Ψ―² –¥–Η–Ι–Ω―³–Β–Ι–Κ –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η―è ―¹ –Ϋ–Β–Ω–Ψ―¹–Μ–Β–¥–Ψ–≤–Α―²–Β–Μ–Ϋ–Η –Φ–Ψ–¥–Β–Μ–Η –Ϋ–Α –Ψ―²―Ä–Α–Ζ―è–≤–Α–Ϋ–Β –Ϋ–Α ―¹–≤–Β―²–Μ–Η–Ϋ–Α―²–Α. –Δ–Β–Ζ–Η –≤–¥―è―¹–Ϋ–Ψ ―¹–Α –Ψ―Ü–≤–Β―²–Β–Ϋ–Η, –Ζ–Α –¥–Α ―¹–Β –Ω–Ψ–¥―΅–Β―Ä―²–Α―è―² –Ϋ–Β―¹―ä–Ψ―²–≤–Β―²―¹―²–≤–Η―è―²–Α. –ö―Ä–Β–¥–Η―² –Ϋ–Α –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η–Β―²–Ψ: Adejumoke Owolabi (CC BY 4.0)

–£―¹–Η―΅–Κ–Η ―²–Β–Ζ–Η –Ψ―΅–Η ―¹–Α –Ψ―² –¥–Η–Ι–Ω―³–Β–Ι–Κ –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η―è ―¹ –Ϋ–Β–Ω–Ψ―¹–Μ–Β–¥–Ψ–≤–Α―²–Β–Μ–Ϋ–Η –Φ–Ψ–¥–Β–Μ–Η –Ϋ–Α –Ψ―²―Ä–Α–Ζ―è–≤–Α–Ϋ–Β –Ϋ–Α ―¹–≤–Β―²–Μ–Η–Ϋ–Α―²–Α. –Δ–Β–Ζ–Η –≤–¥―è―¹–Ϋ–Ψ ―¹–Α –Ψ―Ü–≤–Β―²–Β–Ϋ–Η, –Ζ–Α –¥–Α ―¹–Β –Ω–Ψ–¥―΅–Β―Ä―²–Α―è―² –Ϋ–Β―¹―ä–Ψ―²–≤–Β―²―¹―²–≤–Η―è―²–Α. –ö―Ä–Β–¥–Η―² –Ϋ–Α –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η–Β―²–Ψ: Adejumoke Owolabi (CC BY 4.0)

–½–Α ―¹―²–Α―²–Η―è―²–Α ―¹–Η –Θ–Α–Ι–Μ–¥ ―Ä–Α–Ζ–≥–Ψ–≤–Α―Ä―è ―¹ –ö–Β–≤–Η–Ϋ –ü–Η–Φ–±―ä–Μ―² (Kevin Pimbblet), –¥–Η―Ä–Β–Κ―²–Ψ―Ä –Ϋ–Α –Π–Β–Ϋ―²―ä―Ä–Α –Ζ–Α –≤―ä―Ä―Ö–Ψ–≤–Η –Ω–Ψ―¹―²–Η–Ε–Β–Ϋ–Η―è –≤ –Ψ–±–Μ–Α―¹―²―²–Α –Ϋ–Α –Ϋ–Α―É–Κ–Α―²–Α –Ζ–Α –¥–Α–Ϋ–Ϋ–Η―²–Β, –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Η―è –Η–Ϋ―²–Β–Μ–Β–Κ―² –Η –Φ–Ψ–¥–Β–Μ–Η―Ä–Α–Ϋ–Β―²–Ψ –Κ―ä–Φ –Θ–Ϋ–Η–≤–Β―Ä―¹–Η―²–Β―²–Α –≤ –Ξ―ä–Μ, –£–Β–Μ–Η–Κ–Ψ–±―Ä–Η―²–Α–Ϋ–Η―è. –ü–Η–Φ–±―ä–Μ―² –Ω―Ä–Β–¥―¹―²–Α–≤–Η –Η–Ζ―¹–Μ–Β–¥–≤–Α–Ϋ–Β―²–Ψ –Ϋ–Α –ù–Α―Ü–Η–Ψ–Ϋ–Α–Μ–Ϋ–Α―²–Α ―¹―Ä–Β―â–Α –Ω–Ψ –Α―¹―²―Ä–Ψ–Ϋ–Ψ–Φ–Η―è –Ϋ–Α –ö―Ä–Α–Μ―¹–Κ–Ψ―²–Ψ –Α―¹―²―Ä–Ψ–Ϋ–Ψ–Φ–Η―΅–Β―¹–Κ–Ψ –¥―Ä―É–Ε–Β―¹―²–≤–Ψ –Ϋ–Α –£–Β–Μ–Η–Κ–Ψ–±―Ä–Η―²–Α–Ϋ–Η―è –Ϋ–Α 15 ―é–Μ–Η.

"–Δ–Ψ–≤–Α –Ϋ–Β –Β ―¹―Ä–Β–±―ä―Ä–Β–Ϋ –Κ―É―Ä―à―É–Φ, –Ζ–Α―â–Ψ―²–Ψ –Η–Φ–Α–Φ–Β ―³–Α–Μ―à–Η–≤–Η –Ω–Ψ–Μ–Ψ–Ε–Η―²–Β–Μ–Ϋ–Η –Η ―³–Α–Μ―à–Η–≤–Η –Ψ―²―Ä–Η―Ü–Α―²–Β–Μ–Ϋ–Η ―Ä–Β–Ζ―É–Μ―²–Α―²–Η", –Κ–Ψ–Φ–Β–Ϋ―²–Η―Ä–Α –ü–Η–Φ–±―ä–Μ―². "–ù–Ψ ―²–Ψ–≤–Α –Η–Ζ―¹–Μ–Β–¥–≤–Α–Ϋ–Β –Ω―Ä–Β–¥–Ψ―¹―²–Α–≤―è –Ω–Ψ―²–Β–Ϋ―Ü–Η–Α–Μ–Β–Ϋ –Φ–Β―²–Ψ–¥, –≤–Α–Ε–Β–Ϋ –Ω―ä―² –Ϋ–Α–Ω―Ä–Β–¥, –Κ–Ψ–Ι―²–Ψ –Φ–Ψ–Ε–Β –±–Η ―â–Β ―¹–Β –¥–Ψ–±–Α–≤–Η –Κ―ä–Φ –Ϋ–Α–±–Ψ―Ä–Α –Ψ―² ―²–Β―¹―²–Ψ–≤–Β, –Κ–Ψ–Η―²–Ψ ―΅–Ψ–≤–Β–Κ –Φ–Ψ–Ε–Β –¥–Α –Ω―Ä–Η–Μ–Ψ–Ε–Η, –Ζ–Α –¥–Α ―¹–Β –Ψ–Ω–Η―²–Α –¥–Α ―Ä–Α–Ζ–±–Β―Ä–Β –¥–Α–Μ–Η –Β–¥–Ϋ–Ψ –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η–Β –Β –Η―¹―²–Η–Ϋ―¹–Κ–Ψ –Η–Μ–Η ―³–Α–Μ―à–Η–≤–Ψ."

–Δ–Ψ–≤–Α –Β –Ψ–±–Β―â–Α–≤–Α―â–Ψ ―Ä–Α–Ζ–≤–Η―²–Η–Β. –û―²–≤–Ψ―Ä–Β–Ϋ–Η―²–Β –¥–Β–Φ–Ψ–Κ―Ä–Α―²–Η―΅–Ϋ–Η –Ψ–±―â–Β―¹―²–≤–Α ―¹–Α –Ω–Ψ–¥–Α―²–Μ–Η–≤–Η –Ϋ–Α –¥–Β–Ζ–Η–Ϋ―³–Ψ―Ä–Φ–Α―Ü–Η–Ψ–Ϋ–Ϋ–Η –Α―²–Α–Κ–Η –Ψ―² –≤―ä–Ϋ―à–Ϋ–Η –Η –≤―ä―²―Ä–Β―à–Ϋ–Η –≤―Ä–Α–≥–Ψ–≤–Β. –ü―É–±–Μ–Η―΅–Ϋ–Η―²–Β –Μ–Η―΅–Ϋ–Ψ―¹―²–Η ―¹–Α –Ω–Ψ–¥–Α―²–Μ–Η–≤–Η –Ϋ–Α –Ω–Ψ–¥–Ψ–±–Ϋ–Η –Α―²–Α–Κ–Η. –û–±–Β–Ζ–Ω–Ψ–Κ–Ψ–Η―²–Β–Μ–Ϋ–Ψ –Β, ―΅–Β –Ω–Ψ-–≥–Ψ–Μ―è–Φ–Α―²–Α ―΅–Α―¹―² –Ψ―² –¥–Η–Ι–Ω―³–Β–Ι–Κ–Ψ–≤–Β―²–Β ―¹–Α –Ω–Ψ―Ä–Ϋ–Ψ–≥―Ä–Α―³―¹–Κ–Η –Η –Φ–Ψ–≥–Α―² –¥–Α –Η–Ζ–Ψ–±―Ä–Α–Ζ―è–≤–Α―² –Ω―É–±–Μ–Η―΅–Ϋ–Η –Μ–Η―΅–Ϋ–Ψ―¹―²–Η –≤ ―΅–Α―¹―²–Ϋ–Η –Η –Ω–Ψ–Ϋ―è–Κ–Ψ–≥–Α ―É–Ϋ–Η–Ζ–Η―²–Β–Μ–Ϋ–Η ―¹–Η―²―É–Α―Ü–Η–Η. –£―¹–Η―΅–Κ–Ψ, –Κ–Ψ–Β―²–Ψ –Φ–Ψ–Ε–Β –¥–Α –Ω–Ψ–Φ–Ψ–≥–Ϋ–Β –≤ –±–Ψ―Ä–±–Α―²–Α ―¹ ―²―è―Ö –Η –¥–Α –Ω–Ψ–¥–Κ―Ä–Β–Ω–Η –≥―Ä–Α–Ε–¥–Α–Ϋ―¹–Κ–Ψ―²–Ψ –Ψ–±―â–Β―¹―²–≤–Ψ, –Β –¥–Ψ–±―Ä–Β –¥–Ψ―à–Μ–Ψ.

–ù–Ψ –Κ–Α–Κ―²–Ψ –Ζ–Ϋ–Α–Β–Φ –Ψ―² –Η―¹―²–Ψ―Ä–Η―è―²–Α, –Ϋ–Α–¥–Ω―Ä–Β–≤–Α―Ä–Η―²–Β –≤―ä–≤ –≤―ä–Ψ―Ä―ä–Ε–Α–≤–Α–Ϋ–Β―²–Ψ –Ϋ―è–Φ–Α―² –Κ―Ä–Α–Ι–Ϋ–Α ―²–Ψ―΅–Κ–Α. –Δ–Β –Ω―Ä–Ψ–¥―ä–Μ–Ε–Α–≤–Α―² –Η –Ω―Ä–Ψ–¥―ä–Μ–Ε–Α–≤–Α―² –≤ –Ω–Ψ―Ä–Β–¥–Η―Ü–Α –Ψ―² –Β―¹–Κ–Α–Μ–Η―Ä–Α―â–Η –Κ–Ψ–Ϋ―²―Ä–Α–Φ–Β―Ä–Κ–Η. –£–Η–Ε―²–Β –Κ–Α–Κ –Γ–ê–© –Η –Γ–Γ–Γ–† ―¹–Β –Κ–Ψ–Ϋ–Κ―É―Ä–Η―Ä–Α―Ö–Α –≤–Ζ–Α–Η–Φ–Ϋ–Ψ –Ω–Ψ –≤―Ä–Β–Φ–Β –Ϋ–Α –Ϋ–Α–¥–Ω―Ä–Β–≤–Α―Ä–Α―²–Α –≤ ―è–¥―Ä–Β–Ϋ–Ψ―²–Ψ –≤―ä–Ψ―Ä―ä–Ε–Α–≤–Α–Ϋ–Β, –Κ–Ψ–≥–Α―²–Ψ ―Ä–Α–Ζ–Φ–Β―Ä–Η―²–Β –Ϋ–Α –±–Ψ–Ι–Ϋ–Η―²–Β –≥–Μ–Α–≤–Η –¥–Ψ―¹―²–Η–≥–Ϋ–Α―Ö–Α –Α–±―¹―É―Ä–¥–Ϋ–Η –Ϋ–Η–≤–Α –Ϋ–Α ―Ä–Α–Ζ―Ä―É―à–Η―²–Β–Μ–Ϋ–Α ―¹–Η–Μ–Α. –Δ–Α–Κ–Α ―΅–Β, –¥–Ψ–Κ–Ψ–Μ–Κ–Ψ―²–Ψ ―²–Α–Ζ–Η ―Ä–Α–±–Ψ―²–Α –Β –Ψ–±–Β―â–Α–≤–Α―â–Α, ―Ä–Α–Ζ–Ω―Ä–Ψ―¹―²―Ä–Α–Ϋ–Η―²–Β–Μ–Η―²–Β –Ϋ–Α –¥–Η–Ι–Ω―³–Β–Ι–Κ–Ψ–≤–Β ―â–Β ―¹–Β –Ω–Ψ―É―΅–Α―² –Ψ―² –Ϋ–Β―è –Η ―â–Β –Ω–Ψ–¥–Ψ–±―Ä―è―² –Φ–Β―²–Ψ–¥–Η―²–Β ―¹–Η –Ζ–Α –¥–Η–Ι–Ω―³–Β–Ι–Κ–Ψ–≤–Β ―¹ –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ –Η–Ϋ―²–Β–Μ–Β–Κ―².

–£ ―¹―²–Α―²–Η―è―²–Α ―¹–Η –Θ–Α–Ι–Μ–¥ ―Ä–Α–Ζ–≥–Ψ–≤–Α―Ä―è –Η ―¹ –ë―Ä–Α–Ϋ―² –†–Ψ–±―ä―Ä―²―¹―ä–Ϋ (Brant Robertson). –†–Ψ–±―ä―Ä―²―¹―ä–Ϋ –Β –Α―¹―²―Ä–Ψ―³–Η–Ζ–Η–Κ –≤ –ö–Α–Μ–Η―³–Ψ―Ä–Ϋ–Η–Ι―¹–Κ–Η―è ―É–Ϋ–Η–≤–Β―Ä―¹–Η―²–Β―² –≤ –Γ–Α–Ϋ―²–Α –ö―Ä―É–Ζ, –Κ–Ψ–Ι―²–Ψ –Η–Ζ―É―΅–Α–≤–Α –Α―¹―²―Ä–Ψ―³–Η–Ζ–Η–Κ–Α –Η –Α―¹―²―Ä–Ψ–Ϋ–Ψ–Φ–Η―è, –≤–Κ–Μ―é―΅–Η―²–Β–Μ–Ϋ–Ψ –≥–Ψ–Μ–Β–Φ–Η –Ψ–±–Β–Φ–Η –¥–Α–Ϋ–Ϋ–Η –Η –Φ–Α―à–Η–Ϋ–Ϋ–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β. "–£―ä–Ω―Ä–Β–Κ–Η ―²–Ψ–≤–Α, –Α–Κ–Ψ –Φ–Ψ–Ε–Β―²–Β –¥–Α –Η–Ζ―΅–Η―¹–Μ–Η―²–Β –Φ–Β―²―Ä–Η–Κ–Α, –Κ–Ψ―è―²–Ψ –Κ–Ψ–Μ–Η―΅–Β―¹―²–≤–Β–Ϋ–Ψ –Ψ–Ω―Ä–Β–¥–Β–Μ―è –Κ–Ψ–Μ–Κ–Ψ ―Ä–Β–Α–Μ–Η―¹―²–Η―΅–Ϋ–Ψ –Φ–Ψ–Ε–Β –¥–Α –Η–Ζ–≥–Μ–Β–Ε–¥–Α –Β–¥–Ϋ–Ψ –¥–Η–Ι–Ω―³–Β–Ι–Κ –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η–Β, –Φ–Ψ–Ε–Β―²–Β ―¹―ä―â–Ψ ―²–Α–Κ–Α –¥–Α –Ψ–±―É―΅–Η―²–Β –Φ–Ψ–¥–Β–Μ–Α –Ϋ–Α –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Η―è –Η–Ϋ―²–Β–Μ–Β–Κ―² –¥–Α –Ω―Ä–Ψ–Η–Ζ–≤–Β–Ε–¥–Α –Ψ―â–Β –Ω–Ψ-–¥–Ψ–±―Ä–Η ―³–Α–Μ―à–Η―³–Η–Κ–Α―²–Η, –Ψ–Ω―²–Η–Φ–Η–Ζ–Η―Ä–Α–Ι–Κ–Η ―²–Α–Ζ–Η –Φ–Β―²―Ä–Η–Κ–Α", –Ψ―²–±–Β–Μ―è–Ζ–≤–Α –†–Ψ–±―ä―Ä―²―¹―ä–Ϋ, –Ω–Ψ―²–≤―ä―Ä–Ε–¥–Α–≤–Α–Ι–Κ–Η ―²–Ψ–≤–Α, –Κ–Ψ–Β―²–Ψ –Φ–Ϋ–Ψ–Ζ–Η–Ϋ–Α –Ω―Ä–Β–¥–≤–Η–Ε–¥–Α―².

–ù–Β –Ζ–Α –Ω―Ä―ä–≤ –Ω―ä―² –Α―¹―²―Ä–Ψ–Ϋ–Ψ–Φ–Η―΅–Β―¹–Κ–Η –Φ–Β―²–Ψ–¥–Η ―¹–Β –Ω―Ä–Β―¹–Η―΅–Α―² ―¹―ä―¹ –Ζ–Β–Φ–Ϋ–Η –Ω―Ä–Ψ–±–Μ–Β–Φ–Η. –ö–Ψ–≥–Α―²–Ψ –Β –±–Η–Μ ―Ä–Α–Ζ―Ä–Α–±–Ψ―²–Β–Ϋ –Κ–Ψ―¹–Φ–Η―΅–Β―¹–Κ–Η―è―² ―²–Β–Μ–Β―¹–Κ–Ψ–Ω –Ξ―ä–±―ä–Μ, ―²–Ψ–Ι –Β ―¹―ä–¥―ä―Ä–Ε–Α–Μ –Φ–Ψ―â–Ϋ–Ψ CCD (―É―¹―²―Ä–Ψ–Ι―¹―²–≤–Ψ ―¹―ä―¹ –Ζ–Α―Ä―è–¥–Ϋ–Α –≤―Ä―ä–Ζ–Κ–Α - charge-coupled device). –Δ–Α–Ζ–Η ―²–Β―Ö–Ϋ–Ψ–Μ–Ψ–≥–Η―è ―¹–Η –Β –Ω―Ä–Ψ–Ω―Ä–Α–≤–Η–Μ–Α –Ω―ä―² –≤ ―¹–Η―¹―²–Β–Φ–Α―²–Α –Ζ–Α –¥–Η–≥–Η―²–Α–Μ–Ϋ–Α –Φ–Α–Φ–Ψ–≥―Ä–Α―³―¹–Κ–Α –±–Η–Ψ–Ω―¹–Η―è. –Γ–Η―¹―²–Β–Φ–Α―²–Α –Ω–Ψ–Ζ–≤–Ψ–Μ―è–≤–Α –Ϋ–Α –Μ–Β–Κ–Α―Ä–Η―²–Β –¥–Α –Ω―Ä–Α–≤―è―² –Ω–Ψ-–¥–Ψ–±―Ä–Η –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η―è –Ϋ–Α ―²―ä–Κ–Α–Ϋ―²–Α –Ϋ–Α –≥―ä―Ä–¥–Α―²–Α –Η –¥–Α –Η–¥–Β–Ϋ―²–Η―³–Η―Ü–Η―Ä–Α―² –Ω–Ψ–¥–Ψ–Ζ―Ä–Η―²–Β–Μ–Ϋ–Α ―²―ä–Κ–Α–Ϋ –±–Β–Ζ ―³–Η–Ζ–Η―΅–Β―¹–Κ–Α –±–Η–Ψ–Ω―¹–Η―è. –Γ–Β–≥–Α CCD ―É―¹―²―Ä–Ψ–Ι―¹―²–≤–Α―²–Α ―¹–Α –≤ –Ψ―¹–Ϋ–Ψ–≤–Α―²–Α –Ϋ–Α –≤―¹–Η―΅–Κ–Η –Ϋ–Α―à–Η ―Ü–Η―³―Ä–Ψ–≤–Η ―³–Ψ―²–Ψ–Α–Ω–Α―Ä–Α―²–Η, –≤–Κ–Μ―é―΅–Η―²–Β–Μ–Ϋ–Ψ –Η –Ϋ–Α –Φ–Ψ–±–Η–Μ–Ϋ–Η―²–Β –Ϋ–Η ―²–Β–Μ–Β―³–Ψ–Ϋ–Η.

–£―ä–Ζ–Φ–Ψ–Ε–Ϋ–Ψ –Μ–Η –Β –Β–¥–Η–Ϋ –¥–Β–Ϋ –Η–Ϋ―²–Β―Ä–Ϋ–Β―² –±―Ä–Α―É–Ζ―ä―Ä–Η―²–Β –Ϋ–Η –¥–Α ―¹―ä–¥―ä―Ä–Ε–Α―² –¥–Β―²–Β–Κ―²–Ψ―Ä –Ζ–Α –¥―ä–Μ–±–Ψ–Κ–Η ―³–Α–Μ―à–Η―³–Η–Κ–Α―Ü–Η–Η, –±–Α–Ζ–Η―Ä–Α–Ϋ –Ϋ–Α –î–Ε–Η–Ϋ–Η –Η CAS? –ö–Α–Κ ―â–Β ―Ä–Α–±–Ψ―²–Η ―²–Ψ–≤–Α? –î–Α–Μ–Η –Ζ–Μ–Ψ–Ϋ–Α–Φ–Β―Ä–Β–Ϋ–Η―²–Β ―¹―É–±–Β–Κ―²–Η –±–Η―Ö–Α –Ψ―²–Ω―Ä–Η―â–Η–Μ–Η –Α―²–Α–Κ–Η ―¹―Ä–Β―â―É ―²–Β–Ζ–Η –¥–Β―²–Β–Κ―²–Ψ―Ä–Η –Η ―¹–Μ–Β–¥ ―²–Ψ–≤–Α –±–Η―Ö–Α –Ϋ–Α–≤–Ψ–¥–Ϋ–Η–Μ–Η –Φ–Β–¥–Η–Η―²–Β –Ϋ–Η ―¹ –¥–Η–Ι–Ω―³–Β–Ι–Κ –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η―è –≤ –Ψ–Ω–Η―² –¥–Α –Ψ―²―¹–Μ–Α–±―è―² –¥–Β–Φ–Ψ–Κ―Ä–Α―²–Η―΅–Ϋ–Η―²–Β –Ϋ–Η –Ψ–±―â–Β―¹―²–≤–Α? –Δ–Ψ–≤–Α –Β –Β―¹―²–Β―¹―²–≤–Ψ―²–Ψ –Ϋ–Α –Ϋ–Α–¥–Ω―Ä–Β–≤–Α―Ä–Α―²–Α –≤―ä–≤ –≤―ä–Ψ―Ä―ä–Ε–Α–≤–Α–Ϋ–Β―²–Ψ.

–£ –Ω―Ä–Η―Ä–Ψ–¥–Α―²–Α –Ϋ–Η –Β –Η –¥–Α –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α–Φ–Β –Η–Ζ–Φ–Α–Φ–Α, –Ζ–Α –¥–Α –≤–Μ–Η―è–Β–Φ –Ϋ–Α ―¹―ä–±–Η―²–Η―è―²–Α. –‰―¹―²–Ψ―Ä–Η―è―²–Α –Ω–Ψ–Κ–Α–Ζ–≤–Α, ―΅–Β ―É–Ω―Ä–Α–≤–Ϋ–Η―Ü–Η―²–Β ―¹―ä―¹ –Ζ–Μ–Ψ–Ϋ–Α–Φ–Β―Ä–Β–Ϋ–Η –Ω–Ψ–¥–±―É–¥–Η –Φ–Ψ–≥–Α―² –Ω–Ψ-–Μ–Β―¹–Ϋ–Ψ –¥–Α –Η–Ζ–Φ–Α–Φ―è―² –Ϋ–Α―¹–Β–Μ–Β–Ϋ–Η–Β―²–Ψ, –Κ–Ψ–Β―²–Ψ –Β –≤ –Ω–Μ–Β–Ϋ –Ϋ–Α ―¹–Η–Μ–Ϋ–Η –Β–Φ–Ψ―Ü–Η–Η. –î–Η–Ι–Ω―³–Β–Ι–Κ–Ψ–≤–Β―²–Β ―¹ –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ –Η–Ϋ―²–Β–Μ–Β–Κ―² ―¹–Α ―¹–Α–Φ–Ψ –Ϋ–Α–Ι-–Ϋ–Ψ–≤–Η―è―² –Η–Ϋ―¹―²―Ä―É–Φ–Β–Ϋ―², ―¹ –Κ–Ψ–Ι―²–Ψ ―Ä–Α–Ζ–Ω–Ψ–Μ–Α–≥–Α―².

–£―¹–Η―΅–Κ–Η –Ζ–Ϋ–Α–Β–Φ, ―΅–Β –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Η―è―² –Η–Ϋ―²–Β–Μ–Β–Κ―² –Η–Φ–Α –Ϋ–Β–¥–Ψ―¹―²–Α―²―ä―Ü–Η, –Α –¥–Η–Ι–Ω―³–Β–Ι–Κ–Ψ–≤–Β―²–Β ―¹–Α –Β–¥–Η–Ϋ –Ψ―² ―²―è―Ö. –£―ä–Ω―Ä–Β–Κ–Η ―΅–Β –Ζ–Α–Κ–Ψ–Ϋ–Ϋ–Ψ―¹―²―²–Α –Η–Φ –Β –Ϋ–Β―è―¹–Ϋ–Α, –Κ–Α–Κ―²–Ψ –Ω―Ä–Η –Φ–Ϋ–Ψ–≥–Ψ –Ϋ–Ψ–≤–Η ―²–Β―Ö–Ϋ–Ψ–Μ–Ψ–≥–Η–Η, –≤–Β―΅–Β¬†―¹–Β –Ω–Ψ–Μ–Α–≥–Α―² ―É―¹–Η–Μ–Η―è –Ζ–Α –±–Ψ―Ä–±–Α ―¹ ―²―è―Ö. –£ –Γ–ê–© ―¹–Α –Ω―Ä–Β–¥–Μ–Ψ–Ε–Β–Ϋ–Η –Ϋ―è–Κ–Ψ–Μ–Κ–Ψ –Ζ–Α–Κ–Ψ–Ϋ–Α –Ζ–Α ―¹–Ω―Ä–Α–≤―è–Ϋ–Β ―¹ ―²―è―Ö. –ü―Ä–Β–Ζ ―¹–Β–Ω―²–Β–Φ–≤―Ä–Η 2023 –≥. –≤ –ö–Α–Φ–Α―Ä–Α―²–Α –Ϋ–Α –Ω―Ä–Β–¥―¹―²–Α–≤–Η―²–Β–Μ–Η―²–Β –Ϋ–Α –Γ–ê–© –Β –≤–Ϋ–Β―¹–Β–Ϋ "–½–Α–Κ–Ψ–Ϋ –Ζ–Α –Ψ―²―΅–Β―²–Ϋ–Ψ―¹―²¬†–Ϋ–Α –¥–Η–Ι–Ω―³–Β–Ι–Κ–Ψ–≤–Β―²–Β" (DEEPFAKES Accountability ActβÄù). "–½–Α–Κ–Ψ–Ϋ –Ζ–Α –Ζ–Α―â–Η―²–Α –Ϋ–Α –Ω–Ψ―²―Ä–Β–±–Η―²–Β–Μ–Η―²–Β –Ψ―² –Η–Ζ–Φ–Α–Φ–Ϋ–Η –Ω―Ä–Ψ–¥―É–Κ―²–Η ―¹ –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ –Η–Ϋ―²–Β–Μ–Β–Κ―²" (βÄ€Protecting Consumers from Deceptive AI ActβÄù) –Β –¥―Ä―É–≥–Ψ ―¹–≤―ä―Ä–Ζ–Α–Ϋ–Ψ –Ω―Ä–Β–¥–Μ–Ψ–Ε–Β–Ϋ–Η–Β. –‰ –¥–≤–Β―²–Β –Ζ–Α―¹–Β–≥–Α ―¹–Α –≤¬†–Ω–Ψ–¥–Κ–Ψ–Φ–Η―¹–Η–Η―²–Β, –Ϋ–Ψ –Η–Φ–Α –Ϋ–Α–¥–Β–Ε–¥–Α –≤ –Κ―Ä–Α–Ι–Ϋ–Α ―¹–Φ–Β―²–Κ–Α –¥–Α ―¹―²–Α–Ϋ–Α―² –Ζ–Α–Κ–Ψ–Ϋ–Η.¬†

–½–Α–Β–Φ–Α–Ι–Κ–Η –Ω―Ä–Ψ–Α–Κ―²–Η–≤–Ϋ–Α –Ω–Ψ–Ζ–Η―Ü–Η―è,¬†–ï–≤―Ä–Ψ–Ω–Β–Ι―¹–Κ–Η―è ―¹―ä―é–Ζ –Ω―Ä–Η–Μ–Α–≥–Α ―¹―²―Ä–Ψ–≥–Η –Φ–Β―Ä–Κ–Η, –Ϋ–Α―¹–Ψ―΅–Β–Ϋ–Η –Κ―ä–Φ ―Ä–Β–≥―É–Μ–Η―Ä–Α–Ϋ–Β –Ϋ–Α ―¹–Η―¹―²–Β–Φ–Η―²–Β ―¹ –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ –Η–Ϋ―²–Β–Μ–Β–Κ―² (AI), –≤–Κ–Μ―é―΅–Η―²–Β–Μ–Ϋ–Ψ ―¹―³–Β―Ä–Α―²–Α –Ϋ–Α –¥–Η–Ι–Ω―³–Β–Ι–Κ–Ψ–≤–Β―²–Β ―΅―Ä–Β–Ζ –Ϋ–Β–Ψ―²–¥–Α–≤–Ϋ–Α―à–Ϋ–Ψ―²–Ψ –Ω―Ä–Η–Β–Φ–Α–Ϋ–Β –Ϋ–Α –½–Α–Κ–Ψ–Ϋ–Α –Ζ–Α AI.¬†–½–Α–Κ–Ψ–Ϋ―ä―² –Ζ–Α¬†AI –Ϋ–Α –ï–Γ –Β ―Ü―è–Μ–Ψ―¹―²–Ϋ–Α –Ζ–Α–Κ–Ψ–Ϋ–Ψ–¥–Α―²–Β–Μ–Ϋ–Α ―Ä–Α–Φ–Κ–Α, –Ω―Ä–Β–¥–Μ–Ψ–Ε–Β–Ϋ–Α –Ψ―² –ï–≤―Ä–Ψ–Ω–Β–Ι―¹–Κ–Η―è ―¹―ä―é–Ζ, –Ϋ–Α―¹–Ψ―΅–Β–Ϋ–Α –Κ―ä–Φ ―Ä–Β–≥―É–Μ–Η―Ä–Α–Ϋ–Β –Ϋ–Α ―²–Β―Ö–Ϋ–Ψ–Μ–Ψ–≥–Η–Η―²–Β –Ζ–Α –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ –Η–Ϋ―²–Β–Μ–Β–Κ―², –Ζ–Α –¥–Α –≥–Α―Ä–Α–Ϋ―²–Η―Ä–Α, ―΅–Β ―¹–Η―¹―²–Β–Φ–Η―²–Β –Ζ–Α AI, –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α–Ϋ–Η –≤ –ï–Γ, ―¹–Α –±–Β–Ζ–Ψ–Ω–Α―¹–Ϋ–Η, –Ω―Ä–Ψ–Ζ―Ä–Α―΅–Ϋ–Η –Η –Ζ–Α―΅–Η―²–Α―² –Ψ―¹–Ϋ–Ψ–≤–Ϋ–Η―²–Β –Ω―Ä–Α–≤–Α.¬†

–ù–Ψ –Ω―Ä–Η –Μ–Η–Ω―¹–Α―²–Α –Ϋ–Α ―Ü―è–Μ–Ψ―¹―²–Ϋ–Α –Ω―Ä–Α–≤–Ϋ–Α ―Ä–Α–Φ–Κ–Α, –Κ–Ψ―è―²–Ψ –¥–Α ―¹–Β –Ζ–Α–Ϋ–Η–Φ–Α–≤–Α ―¹ –¥–Η–Ι–Ω―³–Α–Ι–Κ–Ψ–≤–Β―²–Β ―¹ –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ –Η–Ϋ―²–Β–Μ–Β–Κ―², –Η –¥–Ψ―Ä–Η ―¹–Μ–Β–¥ –Κ–Α―²–Ψ ―²–Α–Κ–Α–≤–Α –±―ä–¥–Β ―¹―ä–Ζ–¥–Α–¥–Β–Ϋ–Α, –Ψ―²–Κ―Ä–Η–≤–Α–Ϋ–Β―²–Ψ –≤―¹–Β –Ψ―â–Β –Β –Ψ―² –Κ–Μ―é―΅–Ψ–≤–Ψ –Ζ–Ϋ–Α―΅–Β–Ϋ–Η–Β.

–ê―¹―²―Ä–Ψ–Ϋ–Ψ–Φ–Η―è―²–Α –Η –Α―¹―²―Ä–Ψ―³–Η–Ζ–Η–Κ–Α―²–Α –±–Η―Ö–Α –Φ–Ψ–≥–Μ–Η –¥–Α ―¹–Β –Ψ–Κ–Α–Ε–Α―² –Ϋ–Β–Ψ–±–Η―΅–Α–Β–Ϋ ―¹―ä―é–Ζ–Ϋ–Η–Κ –≤ –±–Ψ―Ä–±–Α―²–Α ―¹ ―²―è―Ö.

–Γ–Ω―Ä–Α–≤–Κ–Α:¬†AI βĉdeepfakeβÄô faces detected using astronomy methods,¬†Sarah Wild,¬†–‰,¬†doi: https://doi.org/10.1038/d41586-024-02364-y¬†

–‰–Ζ―²–Ψ―΅–Ϋ–Η–Κ:¬†Astronomers Have Tools That Can Help Detect Deepfake Images,¬†universetoday

–û―â–Β –Ω–Ψ ―²–Β–Φ–Α―²–Α

–Δ–Β―Ö–Ϋ–Ψ–Μ–Ψ–≥–Η–Η

–†–Α–Κ–Β―²–Η―²–Β –Φ–Ψ–Ε–Β –¥–Α –Ϋ–Β –Ω―Ä–Ψ–±–Η–≤–Α―² –•–Β–Μ–Β–Ζ–Ϋ–Η―è –Κ―É–Ω–Ψ–Μ, –Ϋ–Ψ –Κ–Μ–Α–≤–Η–Α―²―É―Ä–Ϋ–Η―²–Β ―²–Β―Ä–Ψ―Ä–Η―¹―²–Η –Ω―Ä–Β–≤–Ζ–Β–Φ–Α―² ―²–Β―Ä–Η―²–Ψ―Ä–Η–Η

–Δ–Β―Ö–Ϋ–Ψ–Μ–Ψ–≥–Η–Η

–Γ―ä–Ζ–¥–Α–¥–Β–Ϋ –Β ―É–Ϋ–Η–≤–Β―Ä―¹–Α–Μ–Β–Ϋ –Ϋ–Α―΅–Η–Ϋ –Ζ–Α –Ζ–Α–±–Μ―É–¥–Α –Ϋ–Α –¥–Β―²–Β–Κ―²–Ψ―Ä–Η―²–Β –Ϋ–Α –¥–Η–Ι–Ω―³–Β–Ι–Κ –≤–Η–¥–Β–Ψ–Κ–Μ–Η–Ω–Ψ–≤–Β―²–Β

–Δ–Β―Ö–Ϋ–Ψ–Μ–Ψ–≥–Η–Η

–½―É–Κ―ä―Ä–±―ä―Ä–≥: "K–Ψ–Ι―²–Ψ –Κ–Ψ–Ϋ―²―Ä–Ψ–Μ–Η―Ä–Α –¥–Α–Ϋ–Ϋ–Η―²–Β, –Κ–Ψ–Ϋ―²―Ä–Ψ–Μ–Η―Ä–Α –±―ä–¥–Β―â–Β―²–Ψ". –ï–¥–Ϋ–Ψ –¥–Η–Ι–Ω―³–Β–Ι–Κ –≤–Η–¥–Β–Ψ

–ö–Ψ–Φ–Β–Ϋ―²–Α―Ä–Η

–€–Ψ–Μ―è, ―Ä–Β–≥–Η―¹―²―Ä–Η―Ä–Α–Ι―²–Β ―¹–Β –Ψ―² T–Θ–ö!

–ê–Κ–Ψ –≤–Β―΅–Β –Η–Φ–Α―²–Β ―Ä–Β–≥–Η―¹―²―Ä–Α―Ü–Η―è, –Ϋ–Α―²–Η―¹–Ϋ–Β―²–Β –Δ–Θ–ö!

–ù―è–Φ–Α –Κ–Ψ–Φ–Β–Ϋ―²–Α―Ä–Η –Κ―ä–Φ ―²–Α–Ζ–Η –Ϋ–Ψ–≤–Η–Ϋ–Α !

–ü–Ψ―¹–Μ–Β–¥–Ϋ–Η –Κ–Ψ–Φ–Β–Ϋ―²–Α―Ä–Η

YKoshev

–ü―Ä–Β―¹―²–Η–Ε–Ϋ–Α –Ϋ–Α–≥―Ä–Α–¥–Α –Ψ―² –ë–ê–ù ―¹–Ω–Β―΅–Β–Μ–Η –≥–Μ–Α–≤–Ϋ–Η―è―² ―Ä–Β–¥–Α–Κ―²–Ψ―Ä –Ϋ–Α –ù–Α―É–Κ–ΑOFFNews

Johnny B Goode

–ü―Ä–Β―¹―²–Η–Ε–Ϋ–Α –Ϋ–Α–≥―Ä–Α–¥–Α –Ψ―² –ë–ê–ù ―¹–Ω–Β―΅–Β–Μ–Η –≥–Μ–Α–≤–Ϋ–Η―è―² ―Ä–Β–¥–Α–Κ―²–Ψ―Ä –Ϋ–Α –ù–Α―É–Κ–ΑOFFNews

Gunteer

–ü―Ä–Β―¹―²–Η–Ε–Ϋ–Α –Ϋ–Α–≥―Ä–Α–¥–Α –Ψ―² –ë–ê–ù ―¹–Ω–Β―΅–Β–Μ–Η –≥–Μ–Α–≤–Ϋ–Η―è―² ―Ä–Β–¥–Α–Κ―²–Ψ―Ä –Ϋ–Α –ù–Α―É–Κ–ΑOFFNews

–Ξ―Ä–Η―¹―²–Η―è–Ϋ–Η–Ϋ

–Δ–Ψ–≤–Α –Β –Κ―Ä–Α–Μ―è―² –Ϋ–Α ―²–Η–Κ–≤–Η―²–Β: –Δ–Η–Κ–≤–Α―²–Α –Φ―É ―²–Β–Ε–Η –Ϋ–Α–¥ –Β–¥–Η–Ϋ –Β–¥–Η–Ϋ ―²–Ψ–Ϋ