–ö―Ä–Α–Μ―¹–Κ–Α―²–Α ―à–≤–Β–¥―¹–Κ–Α –Α–Κ–Α–¥–Β–Φ–Η―è –Ϋ–Α –Ϋ–Α―É–Κ–Η―²–Β –Ψ–±―è–≤–Η –Ζ–Α –Ϋ–Ψ―¹–Η―²–Β–Μ–Η –Ϋ–Α –ù–Ψ–±–Β–Μ–Ψ–≤–Α –Ϋ–Α–≥―Ä–Α–¥–Α –Ζ–Α ―³–Η–Ζ–Η–Κ–Α –Ζ–Α 2024 –≥–Ψ–¥–Η–Ϋ–Α –î–Ε–Ψ–Ϋ –Ξ–Ψ–Ω―³–Η–Ι–Μ–¥ (John J. Hopfield) –Η –î–Ε–Β―³―Ä–Η –Ξ–Η–Ϋ―²―ä–Ϋ (Geoffrey E. Hinton) βÄû–Ζ–Α –Ψ―¹–Ϋ–Ψ–≤–Ψ–Ω–Ψ–Μ–Α–≥–Α―â–Η –Ψ―²–Κ―Ä–Η―²–Η―è –Η –Η–Ζ–Ψ–±―Ä–Β―²–Β–Ϋ–Η―è, –Κ–Ψ–Η―²–Ψ –Ω–Ψ–Ζ–≤–Ψ–Μ―è–≤–Α―² –Φ–Α―à–Η–Ϋ–Ϋ–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β ―¹ –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Η –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Η –Φ―Ä–Β–Ε–ΗβÄ€.

–Δ–Α–Ζ–≥–Ψ–¥–Η―à–Ϋ–Η―²–Β –Μ–Α―É―Ä–Β–Α―²–Η –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α―² –Η–Ϋ―¹―²―Ä―É–Φ–Β–Ϋ―²–Η –Ψ―² ―³–Η–Ζ–Η–Κ–Α―²–Α, –Ζ–Α –¥–Α ―¹―ä–Ζ–¥–Α–¥–Α―² –Φ–Β―²–Ψ–¥–Η, –Κ–Ψ–Η―²–Ψ –Ω–Ψ–Φ–Α–≥–Α―² –¥–Α ―¹–Β –Ω–Ψ–Μ–Ψ–Ε–Α―² –Ψ―¹–Ϋ–Ψ–≤–Η―²–Β –Ϋ–Α –¥–Ϋ–Β―à–Ϋ–Ψ―²–Ψ –Φ–Ψ―â–Ϋ–Ψ –Φ–Α―à–Η–Ϋ–Ϋ–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β.

–î–Ε–Ψ–Ϋ –Ξ–Ψ–Ω―³–Β–Μ–¥ ―¹―ä–Ζ–¥–Α–≤–Α ―¹―²―Ä―É–Κ―²―É―Ä–Α, –Κ–Ψ―è―²–Ψ –Φ–Ψ–Ε–Β –¥–Α ―¹―ä―Ö―Ä–Α–Ϋ―è–≤–Α –Η –≤―ä–Ζ―¹―²–Α–Ϋ–Ψ–≤―è–≤–Α –Η–Ϋ―³–Ψ―Ä–Φ–Α―Ü–Η―è. –î–Ε–Β―³―Ä–Η –Ξ–Η–Ϋ―²―ä–Ϋ –Η–Ζ–Ψ–±―Ä–Β―²―è–≤–Α –Φ–Β―²–Ψ–¥, –Κ–Ψ–Ι―²–Ψ –Φ–Ψ–Ε–Β ―¹–Α–Φ–Ψ―¹―²–Ψ―è―²–Β–Μ–Ϋ–Ψ –¥–Α –Ψ―²–Κ―Ä–Η–≤–Α ―¹–≤–Ψ–Ι―¹―²–≤–Α –≤ –¥–Α–Ϋ–Ϋ–Η―²–Β –Η –Κ–Ψ–Ι―²–Ψ ―¹―²–Α–≤–Α –≤–Α–Ε–Β–Ϋ –Ζ–Α –≥–Ψ–Μ–Β–Φ–Η―²–Β –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Η –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Η –Φ―Ä–Β–Ε–Η, –Κ–Ψ–Η―²–Ψ ―¹–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α―² ―¹–Β–≥–Α.

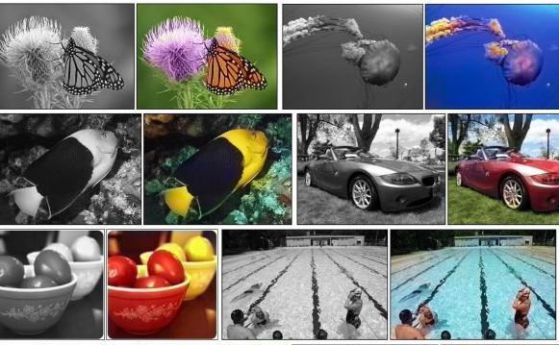

–€–Ϋ–Ψ–≥–Ψ ―Ö–Ψ―Ä–Α ―¹–Α ―¹–Β ―É–±–Β–¥–Η–Μ–Η, ―΅–Β –Κ–Ψ–Φ–Ω―é―²―Ä–Η―²–Β –Φ–Ψ–≥–Α―² –¥–Α –Ω―Ä–Β–≤–Β–Ε–¥–Α―² –Φ–Β–Ε–¥―É ―Ä–Α–Ζ–Μ–Η―΅–Ϋ–Η –Β–Ζ–Η―Ü–Η, –¥–Α –Η–Ϋ―²–Β―Ä–Ω―Ä–Β―²–Η―Ä–Α―² –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η―è –Η –¥–Ψ―Ä–Η –¥–Α –≤–Ψ–¥―è―² ―Ä–Α–Ζ―É–Φ–Ϋ–Η ―Ä–Α–Ζ–≥–Ψ–≤–Ψ―Ä–Η. –€–Ψ–Ε–Β –±–Η –Ω–Ψ-–Φ–Α–Μ–Κ–Ψ –Η–Ζ–≤–Β―¹―²–Ϋ–Ψ –Β, ―΅–Β ―²–Ψ–Ζ–Η ―²–Η–Ω ―²–Β―Ö–Ϋ–Ψ–Μ–Ψ–≥–Η–Η –Ψ―²–¥–Α–≤–Ϋ–Α ―¹–Α –≤–Α–Ε–Ϋ–Η –Ζ–Α –Ϋ–Α―É―΅–Ϋ–Η―²–Β –Η–Ζ―¹–Μ–Β–¥–≤–Α–Ϋ–Η―è, –≤–Κ–Μ―é―΅–Η―²–Β–Μ–Ϋ–Ψ –Ζ–Α ―¹–Ψ―Ä―²–Η―Ä–Α–Ϋ–Β―²–Ψ –Η –Α–Ϋ–Α–Μ–Η–Ζ–Α –Ϋ–Α –Ψ–≥―Ä–Ψ–Φ–Ϋ–Η –Κ–Ψ–Μ–Η―΅–Β―¹―²–≤–Α –¥–Α–Ϋ–Ϋ–Η.

–†–Α–Ζ–≤–Η―²–Η–Β―²–Ψ –Ϋ–Α –Φ–Α―à–Η–Ϋ–Ϋ–Ψ―²–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β ―¹–Β ―Ä–Α–Ζ―Ä–Α―¹–Ϋ–Α –Ω―Ä–Β–Ζ –Ω–Ψ―¹–Μ–Β–¥–Ϋ–Η―²–Β –Ω–Β―²–Ϋ–Α–¥–Β―¹–Β―²-–¥–≤–Α–¥–Β―¹–Β―² –≥–Ψ–¥–Η–Ϋ–Η –Η –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α ―¹―²―Ä―É–Κ―²―É―Ä–Α, –Ϋ–Α―Ä–Β―΅–Β–Ϋ–Α –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Α –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Α –Φ―Ä–Β–Ε–Α. –£ –¥–Ϋ–Β―à–Ϋ–Ψ –≤―Ä–Β–Φ–Β, –Κ–Ψ–≥–Α―²–Ψ –≥–Ψ–≤–Ψ―Ä–Η–Φ –Ζ–Α –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ –Η–Ϋ―²–Β–Μ–Β–Κ―², ―΅–Β―¹―²–Ψ –Η–Φ–Α–Φ–Β –Ω―Ä–Β–¥–≤–Η–¥ –Η–Φ–Β–Ϋ–Ϋ–Ψ ―²–Ψ–Ζ–Η ―²–Η–Ω ―²–Β―Ö–Ϋ–Ψ–Μ–Ψ–≥–Η―è.

–£―ä–Ω―Ä–Β–Κ–Η ―΅–Β –Κ–Ψ–Φ–Ω―é―²―Ä–Η―²–Β –Ϋ–Β –Φ–Ψ–≥–Α―² –¥–Α –Φ–Η―¹–Μ―è―², ―²–Β –≤–Β―΅–Β –Φ–Ψ–≥–Α―² –¥–Α –Η–Φ–Η―²–Η―Ä–Α―² ―³―É–Ϋ–Κ―Ü–Η–Η –Κ–Α―²–Ψ –Ω–Α–Φ–Β―² –Η ―É―΅–Β–Ϋ–Β. –Δ–Α–Ζ–≥–Ψ–¥–Η―à–Ϋ–Η―²–Β –Μ–Α―É―Ä–Β–Α―²–Η –≤ –Ψ–±–Μ–Α―¹―²―²–Α –Ϋ–Α ―³–Η–Ζ–Η–Κ–Α―²–Α ―¹–Α –¥–Ψ–Ω―Ä–Η–Ϋ–Β―¹–Μ–Η ―²–Ψ–≤–Α –¥–Α ―¹―²–Α–Ϋ–Β –≤―ä–Ζ–Φ–Ψ–Ε–Ϋ–Ψ. –‰–Ζ–Ω–Ψ–Μ–Ζ–≤–Α–Ι–Κ–Η ―³―É–Ϋ–¥–Α–Φ–Β–Ϋ―²–Α–Μ–Ϋ–Η –Κ–Ψ–Ϋ―Ü–Β–Ω―Ü–Η–Η –Η –Φ–Β―²–Ψ–¥–Η –Ψ―² ―³–Η–Ζ–Η–Κ–Α―²–Α, ―²–Β ―¹–Α ―Ä–Α–Ζ―Ä–Α–±–Ψ―²–Η–Μ–Η ―²–Β―Ö–Ϋ–Ψ–Μ–Ψ–≥–Η–Η, –Κ–Ψ–Η―²–Ψ –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α―² ―¹―²―Ä―É–Κ―²―É―Ä–Η –≤ –Φ―Ä–Β–Ε–Η –Ζ–Α –Ψ–±―Ä–Α–±–Ψ―²–Κ–Α –Ϋ–Α –Η–Ϋ―³–Ψ―Ä–Φ–Α―Ü–Η―è.

–€–Α―à–Η–Ϋ–Ϋ–Ψ―²–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β ―¹–Β ―Ä–Α–Ζ–Μ–Η―΅–Α–≤–Α –Ψ―² ―²―Ä–Α–¥–Η―Ü–Η–Ψ–Ϋ–Ϋ–Η―è ―¹–Ψ―³―²―É–Β―Ä, –Κ–Ψ–Ι―²–Ψ ―Ä–Α–±–Ψ―²–Η –Κ–Α―²–Ψ –≤–Η–¥ ―Ä–Β―Ü–Β–Ω―²–Α.

–Γ–Ψ―³―²―É–Β―Ä―ä―² –Ω–Ψ–Μ―É―΅–Α–≤–Α –¥–Α–Ϋ–Ϋ–Η, –Κ–Ψ–Η―²–Ψ ―¹–Β –Ψ–±―Ä–Α–±–Ψ―²–≤–Α―² –Ω–Ψ ―è―¹–Ϋ–Ψ –Ψ–Ω–Η―¹–Α–Ϋ–Η–Β –Η –¥–Α–≤–Α―² ―Ä–Β–Ζ―É–Μ―²–Α―²–Η, –Ω–Ψ–¥–Ψ–±–Ϋ–Ψ –Ϋ–Α ―²–Ψ–≤–Α –Κ–Α–Κ –Ϋ―è–Κ–Ψ–Ι ―¹―ä–±–Η―Ä–Α ―¹―ä―¹―²–Α–≤–Κ–Η –Η –≥–Η –Ψ–±―Ä–Α–±–Ψ―²–≤–Α, ―¹–Μ–Β–¥–≤–Α–Ι–Κ–Η ―Ä–Β―Ü–Β–Ω―²–Α, –Κ–Α―²–Ψ –Ω–Ψ–Μ―É―΅–Α–≤–Α –Ϋ–Α–Κ―Ä–Α―è ―²–Ψ―Ä―²–Α.

–£–Φ–Β―¹―²–Ψ ―²–Ψ–≤–Α –Ω―Ä–Η –Φ–Α―à–Η–Ϋ–Ϋ–Ψ―²–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β –Κ–Ψ–Φ–Ω―é―²―ä―Ä―ä―² ―¹–Β ―É―΅–Η ―΅―Ä–Β–Ζ –Ω―Ä–Η–Φ–Β―Ä–Η, –Κ–Ψ–Β―²–Ψ –Φ―É –Ω–Ψ–Ζ–≤–Ψ–Μ―è–≤–Α –¥–Α ―¹–Β ―¹–Ω―Ä–Α–≤―è ―¹ –Ω―Ä–Ψ–±–Μ–Β–Φ–Η, –Κ–Ψ–Η―²–Ψ ―¹–Α ―²–≤―ä―Ä–¥–Β –Ϋ–Β―è―¹–Ϋ–Η –Η ―¹–Μ–Ψ–Ε–Ϋ–Η, –Ζ–Α –¥–Α –±―ä–¥–Α―² ―É–Ω―Ä–Α–≤–Μ―è–≤–Α–Ϋ–Η ―΅―Ä–Β–Ζ –Η–Ϋ―¹―²―Ä―É–Κ―Ü–Η–Η ―¹―²―ä–Ω–Κ–Α –Ω–Ψ ―¹―²―ä–Ω–Κ–Α. –ü―Ä–Η–Φ–Β―Ä –Ζ–Α ―²–Ψ–≤–Α –Β –Η–Ϋ―²–Β―Ä–Ω―Ä–Β―²–Η―Ä–Α–Ϋ–Β―²–Ψ –Ϋ–Α ―¹–Ϋ–Η–Φ–Κ–Α, –Ζ–Α –¥–Α ―¹–Β –Η–¥–Β–Ϋ―²–Η―³–Η―Ü–Η―Ä–Α―² –Ψ–±–Β–Κ―²–Η―²–Β –Ϋ–Α –Ϋ–Β―è.

–‰–Φ–Η―²–Α―Ü–Η―è –Ϋ–Α ―΅–Ψ–≤–Β―à–Κ–Η―è –Φ–Ψ–Ζ―ä–Κ

–ï–¥–Ϋ–Α –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Α –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Α –Φ―Ä–Β–Ε–Α –Ψ–±―Ä–Α–±–Ψ―²–≤–Α –Η–Ϋ―³–Ψ―Ä–Φ–Α―Ü–Η―è, –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α–Ι–Κ–Η ―Ü―è–Μ–Α―²–Α ―¹―²―Ä―É–Κ―²―É―Ä–Α –Ϋ–Α –Φ―Ä–Β–Ε–Α―²–Α. –£–¥―ä―Ö–Ϋ–Ψ–≤–Β–Ϋ–Η–Β―²–Ψ –Ω―ä―Ä–≤–Ψ–Ϋ–Α―΅–Α–Μ–Ϋ–Ψ –Η–¥–≤–Α –Ψ―² –Ε–Β–Μ–Α–Ϋ–Η–Β―²–Ψ –¥–Α ―¹–Β ―Ä–Α–Ζ–±–Β―Ä–Β –Κ–Α–Κ ―Ä–Α–±–Ψ―²–Η ―΅–Ψ–≤–Β―à–Κ–Η―è―² –Φ–Ψ–Ζ―ä–Κ. –ü―Ä–Β–Ζ 40-―²–Β –≥–Ψ–¥–Η–Ϋ–Η –Ϋ–Α –Φ–Η–Ϋ–Α–Μ–Η―è –≤–Β–Κ –Η–Ζ―¹–Μ–Β–¥–Ψ–≤–Α―²–Β–Μ–Η―²–Β ―¹–Α –Ζ–Α–Ω–Ψ―΅–Ϋ–Α–Μ–Η –¥–Α ―Ä–Α–Ζ―¹―ä–Ε–¥–Α–≤–Α―² –≤―ä―Ä―Ö―É –Φ–Α―²–Β–Φ–Α―²–Η–Κ–Α―²–Α, –Κ–Ψ―è―²–Ψ –Β –≤ –Ψ―¹–Ϋ–Ψ–≤–Α―²–Α –Ϋ–Α –Φ―Ä–Β–Ε–Α―²–Α –Ψ―² –Ϋ–Β–≤―Ä–Ψ–Ϋ–Η –Η ―¹–Η–Ϋ–Α–Ω―¹–Η –≤ –Φ–Ψ–Ζ―ä–Κ–Α. –î―Ä―É–≥–Α ―΅–Α―¹―² –Ψ―² –Ω―ä–Ζ–Β–Μ–Α –Η–¥–≤–Α –Ψ―² –Ω―¹–Η―Ö–Ψ–Μ–Ψ–≥–Η―è―²–Α, –±–Μ–Α–≥–Ψ–¥–Α―Ä–Β–Ϋ–Η–Β –Ϋ–Α ―Ö–Η–Ω–Ψ―²–Β–Ζ–Α―²–Α –Ϋ–Α –Ϋ–Β–≤―Ä–Ψ–Μ–Ψ–≥–Α –î–Ψ–Ϋ–Α–Μ–¥ –Ξ–Β–± (Donald Hebb) –Ζ–Α ―²–Ψ–≤–Α –Κ–Α–Κ ―¹–Β –Ψ―¹―ä―â–Β―¹―²–≤―è–≤–Α –Ψ–±―É―΅–Β–Ϋ–Η–Β―²–Ψ, –Ζ–Α―â–Ψ―²–Ψ –≤―Ä―ä–Ζ–Κ–Η―²–Β –Φ–Β–Ε–¥―É –Ϋ–Β–≤―Ä–Ψ–Ϋ–Η―²–Β ―¹–Β –Ω–Ψ–¥―¹–Η–Μ–≤–Α―², –Κ–Ψ–≥–Α―²–Ψ ―Ä–Α–±–Ψ―²―è―² –Ζ–Α–Β–¥–Ϋ–Ψ.

–ü–Ψ-–Κ―ä―¹–Ϋ–Ψ ―²–Β–Ζ–Η –Η–¥–Β–Η ―¹–Α –Ω–Ψ―¹–Μ–Β–¥–≤–Α–Ϋ–Η –Ψ―² –Ψ–Ω–Η―²–Η –Ζ–Α –Ω―Ä–Β―¹―ä–Ζ–¥–Α–≤–Α–Ϋ–Β –Ϋ–Α –Ϋ–Α―΅–Η–Ϋ–Α, –Ω–Ψ –Κ–Ψ–Ι―²–Ψ ―³―É–Ϋ–Κ―Ü–Η–Ψ–Ϋ–Η―Ä–Α –Φ–Ψ–Ζ―ä―΅–Ϋ–Α―²–Α –Φ―Ä–Β–Ε–Α, ―΅―Ä–Β–Ζ –Η–Ζ–≥―Ä–Α–Ε–¥–Α–Ϋ–Β –Ϋ–Α –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Η –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Η –Φ―Ä–Β–Ε–Η –Κ–Α―²–Ψ –Κ–Ψ–Φ–Ω―é―²―ä―Ä–Ϋ–Η ―¹–Η–Φ―É–Μ–Α―Ü–Η–Η. –£ ―²―è―Ö –Φ–Ψ–Ζ―ä―΅–Ϋ–Η―²–Β –Ϋ–Β–≤―Ä–Ψ–Ϋ–Η ―¹–Β –Η–Φ–Η―²–Η―Ä–Α―² ―΅―Ä–Β–Ζ –≤―ä–Ζ–Μ–Η, –Ϋ–Α –Κ–Ψ–Η―²–Ψ ―¹–Β –Ζ–Α–¥–Α–≤–Α―² ―Ä–Α–Ζ–Μ–Η―΅–Ϋ–Η ―¹―²–Ψ–Ι–Ϋ–Ψ―¹―²–Η, –Α ―¹–Η–Ϋ–Α–Ω―¹–Η―²–Β ―¹–Β –Ω―Ä–Β–¥―¹―²–Α–≤―è―² ―΅―Ä–Β–Ζ –≤―Ä―ä–Ζ–Κ–Η –Φ–Β–Ε–¥―É –≤―ä–Ζ–Μ–Η―²–Β, –Κ–Ψ–Η―²–Ψ –Φ–Ψ–≥–Α―² –¥–Α ―¹–Β –Ω―Ä–Α–≤―è―² –Ω–Ψ-―¹–Η–Μ–Ϋ–Η –Η–Μ–Η –Ω–Ψ-―¹–Μ–Α–±–Η. –Ξ–Η–Ω–Ψ―²–Β–Ζ–Α―²–Α –Ϋ–Α –î–Ψ–Ϋ–Α–Μ–¥ –Ξ–Β–± –≤―¹–Β –Ψ―â–Β ―¹–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –Κ–Α―²–Ψ –Β–¥–Ϋ–Α –Ψ―² –Ψ―¹–Ϋ–Ψ–≤–Ϋ–Η―²–Β –Ω―Ä–Α–≤–Η–Μ–Α –Ζ–Α –Α–Κ―²―É–Α–Μ–Η–Ζ–Η―Ä–Α–Ϋ–Β –Ϋ–Α –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Η―²–Β –Φ―Ä–Β–Ε–Η ―΅―Ä–Β–Ζ –Ω―Ä–Ψ―Ü–Β―¹, –Ϋ–Α―Ä–Β―΅–Β–Ϋ –Ψ–±―É―΅–Β–Ϋ–Η–Β.

–ï―¹―²–Β―¹―²–≤–Β–Ϋ–Η –Η –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Η –Ϋ–Β–≤―Ä–Ψ–Ϋ–Η

|

–ù–Β–≤―Ä–Ψ–Ϋ–Ϋ–Α―²–Α –Φ―Ä–Β–Ε–Α –Ϋ–Α –Φ–Ψ–Ζ―ä–Κ–Α –Β –Η–Ζ–≥―Ä–Α–¥–Β–Ϋ–Α –Ψ―² –Ε–Η–≤–Η –Κ–Μ–Β―²–Κ–Η, –Ϋ–Β–≤―Ä–Ψ–Ϋ–Η, ―¹ ―É―¹―ä–≤―ä―Ä―à–Β–Ϋ―¹―²–≤–Α–Ϋ –≤―ä―²―Ä–Β―à–Β–Ϋ –Φ–Β―Ö–Α–Ϋ–Η–Ζ―ä–Φ. –Δ–Β –Φ–Ψ–≥–Α―² –¥–Α –Η–Ζ–Ω―Ä–Α―â–Α―² ―¹–Η–≥–Ϋ–Α–Μ–Η –Ω–Ψ–Φ–Β–Ε–¥―É ―¹–Η ―΅―Ä–Β–Ζ ―¹–Η–Ϋ–Α–Ω―¹–Η. –ö–Ψ–≥–Α―²–Ψ –Ϋ–Α―É―΅–Α–≤–Α–Φ–Β –Ϋ–Β―â–Ψ, –≤―Ä―ä–Ζ–Κ–Η―²–Β –Φ–Β–Ε–¥―É –Ϋ―è–Κ–Ψ–Η –Ϋ–Β–≤―Ä–Ψ–Ϋ–Η ―¹–Β –Ζ–Α―¹–Η–Μ–≤–Α―², –¥–Ψ–Κ–Α―²–Ψ –¥―Ä―É–≥–Η –Ψ―²―¹–Μ–Α–±–≤–Α―². |

|

–‰–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Η―²–Β –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Η –Φ―Ä–Β–Ε–Η ―¹–Α –Η–Ζ–≥―Ä–Α–¥–Β–Ϋ–Η –Ψ―² –≤―ä–Ζ–Μ–Η, –Κ–Ψ–Η―²–Ψ ―¹–Α –Κ–Ψ–¥–Η―Ä–Α–Ϋ–Η ―¹―ä―¹ ―¹―²–Ψ–Ι–Ϋ–Ψ―¹―². –£―ä–Ζ–Μ–Η―²–Β ―¹–Α ―¹–≤―ä―Ä–Ζ–Α–Ϋ–Η –Ω–Ψ–Φ–Β–Ε–¥―É ―¹–Η –Η –Κ–Ψ–≥–Α―²–Ψ –Φ―Ä–Β–Ε–Α―²–Α ―¹–Β –Ψ–±―É―΅–Α–≤–Α, –≤―Ä―ä–Ζ–Κ–Η―²–Β –Φ–Β–Ε–¥―É –≤―ä–Ζ–Μ–Η―²–Β, –Κ–Ψ–Η―²–Ψ ―¹–Α –Α–Κ―²–Η–≤–Ϋ–Η –Ω–Ψ –Β–¥–Ϋ–Ψ –Η ―¹―ä―â–Ψ –≤―Ä–Β–Φ–Β, ―¹–Β –Ζ–Α―¹–Η–Μ–≤–Α―², –Α –≤ –Ω―Ä–Ψ―²–Η–≤–Β–Ϋ ―¹–Μ―É―΅–Α–Ι –Ψ―²―¹–Μ–Α–±–≤–Α―². |

|

–ö―Ä–Β–¥–Η―²:¬†¬© Johan Jarnestad/The Royal Swedish Academy of Sciences

–£ –Κ―Ä–Α―è –Ϋ–Α 60-―²–Β –≥–Ψ–¥–Η–Ϋ–Η –Ϋ–Α –Φ–Η–Ϋ–Α–Μ–Η―è –≤–Β–Κ –Ϋ―è–Κ–Ψ–Η –Ψ–±–Β–Ζ–Κ―É―Ä–Α–Ε–Α–≤–Α―â–Η ―²–Β–Ψ―Ä–Β―²–Η―΅–Ϋ–Η ―Ä–Β–Ζ―É–Μ―²–Α―²–Η –Κ–Α―Ä–Α―² –Φ–Ϋ–Ψ–≥–Ψ –Η–Ζ―¹–Μ–Β–¥–Ψ–≤–Α―²–Β–Μ–Η –¥–Α –Ω―Ä–Β–¥–Ω–Ψ–Μ–Ψ–Ε–Α―², ―΅–Β –Ψ―² ―²–Β–Ζ–Η –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Η –Φ―Ä–Β–Ε–Η –Ϋ–Η–Κ–Ψ–≥–Α –Ϋ―è–Φ–Α –¥–Α –Η–Φ–Α ―Ä–Β–Α–Μ–Ϋ–Α –Ω–Ψ–Μ–Ζ–Α. –‰–Ϋ―²–Β―Ä–Β―¹―ä―² –Κ―ä–Φ –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Η―²–Β –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Η –Φ―Ä–Β–Ε–Η –Ψ–±–Α―΅–Β ―¹–Β ―¹―ä–±―É–Ε–¥–Α –Ψ―²–Ϋ–Ψ–≤–Ψ –Ω―Ä–Β–Ζ 80-―²–Β –≥–Ψ–¥–Η–Ϋ–Η –Ϋ–Α –Ξ–Ξ –≤–Β–Κ, –Κ–Ψ–≥–Α―²–Ψ –Ϋ―è–Κ–Ψ–Μ–Κ–Ψ –≤–Α–Ε–Ϋ–Η –Η–¥–Β–Η –Ψ–Κ–Α–Ζ–≤–Α―² –≤–Μ–Η―è–Ϋ–Η–Β, –≤–Κ–Μ―é―΅–Η―²–Β–Μ–Ϋ–Ψ –Η ―Ä–Α–±–Ψ―²–Α―²–Α –Ϋ–Α ―²–Α–Ζ–≥–Ψ–¥–Η―à–Ϋ–Η―²–Β –Μ–Α―É―Ä–Β–Α―²–Η.

–ê―¹–Ψ―Ü–Η–Α―²–Η–≤–Ϋ–Α –Ω–Α–Φ–Β―²

–ü―Ä–Β–¥―¹―²–Α–≤–Β―²–Β ―¹–Η, ―΅–Β ―¹–Β –Ψ–Ω–Η―²–≤–Α―²–Β –¥–Α –Ζ–Α–Ω–Ψ–Φ–Ϋ–Η―²–Β –¥–Ψ―¹―²–Α –Ϋ–Β–Ψ–±–Η―΅–Α–Ι–Ϋ–Α –¥―É–Φ–Α, –Κ–Ψ―è―²–Ψ ―Ä―è–¥–Κ–Ψ –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α―²–Β, –Ϋ–Α–Ω―Ä–Η–Φ–Β―Ä ―²–Α–Κ–Α–≤–Α –Ζ–Α –Ψ–Ϋ–Ζ–Η –Ϋ–Α–Κ–Μ–Ψ–Ϋ–Β–Ϋ –Ω–Ψ–¥, –Κ–Ψ–Ι―²–Ψ ―΅–Β―¹―²–Ψ ―¹–Β ―¹―Ä–Β―â–Α –≤ –Κ–Η–Ϋ–Α―²–Α –Η –Μ–Β–Κ―Ü–Η–Ψ–Ϋ–Ϋ–Η―²–Β –Ζ–Α–Μ–Η. –Δ―ä―Ä―¹–Η―²–Β –≤ –Ω–Α–Φ–Β―²―²–Α ―¹–Η. –Δ–Ψ–≤–Α –Β –Ϋ–Β―â–Ψ –Κ–Α―²–Ψ ―Ä–Α–Φ–Ω–Α... –Φ–Ψ–Ε–Β –±–Η ―Ä–Α–¥...–Η–Α–Μ–Ϋ–Α? –ù–Β, –Ϋ–Β –Β ―²–Ψ–≤–Α. –™―Ä–Α–±–Β–Ε, ―²–Ψ–≤–Α –Β! –Δ–Ψ–Ζ–Η –Ω―Ä–Ψ―Ü–Β―¹ –Ϋ–Α ―²―ä―Ä―¹–Β–Ϋ–Β –Ϋ–Α ―¹―Ö–Ψ–¥–Ϋ–Η –¥―É–Φ–Η, –Ζ–Α –¥–Α ―¹–Β –Ϋ–Α–Φ–Β―Ä–Η –Ω―Ä–Α–≤–Η–Μ–Ϋ–Α―²–Α, –Ϋ–Α–Ω–Ψ–Φ–Ϋ―è –Ϋ–Α –Α―¹–Ψ―Ü–Η–Α―²–Η–≤–Ϋ–Α―²–Α –Ω–Α–Φ–Β―², –Κ–Ψ―è―²–Ψ ―³–Η–Ζ–Η–Κ―ä―² –î–Ε–Ψ–Ϋ –Ξ–Ψ–Ω―³–Η–Ι–Μ–¥ –Ψ―²–Κ―Ä–Η–≤–Α –Ω―Ä–Β–Ζ 1982 –≥. –€―Ä–Β–Ε–Α―²–Α –Ϋ–Α –Ξ–Ψ–Ω―³–Η–Ι–Μ–¥ –Φ–Ψ–Ε–Β –¥–Α ―¹―ä―Ö―Ä–Α–Ϋ―è–≤–Α –Φ–Ψ–¥–Β–Μ–Η –Η –Η–Φ–Α –Φ–Β―²–Ψ–¥ –Ζ–Α ―²―è―Ö–Ϋ–Ψ―²–Ψ –Ω―Ä–Β―¹―ä–Ζ–¥–Α–≤–Α–Ϋ–Β. –ö–Ψ–≥–Α―²–Ψ –Ϋ–Α –Φ―Ä–Β–Ε–Α―²–Α ―¹–Β –Ω―Ä–Β–¥–Ψ―¹―²–Α–≤–Η –Ϋ–Β–Ω―ä–Μ–Β–Ϋ –Η–Μ–Η –Μ–Β–Κ–Ψ –Η–Ζ–Κ―Ä–Η–≤–Β–Ϋ –Φ–Ψ–¥–Β–Μ, –Φ–Β―²–Ψ–¥―ä―² –Φ–Ψ–Ε–Β –¥–Α –Ϋ–Α–Φ–Β―Ä–Η –Ζ–Α–Ω–Α–Φ–Β―²–Β–Ϋ–Η―è –Φ–Ψ–¥–Β–Μ, –Κ–Ψ–Ι―²–Ψ –Β –Ϋ–Α–Ι-–Ω–Ψ–¥–Ψ–±–Β–Ϋ. –ü―Ä–Β–¥–Η ―²–Ψ–≤–Α –Ξ–Ψ–Ω―³–Η–Ι–Μ–¥ –Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α–Μ –Ψ–Ω–Η―²–Α ―¹–Η –≤ –Ψ–±–Μ–Α―¹―²―²–Α –Ϋ–Α ―³–Η–Ζ–Η–Κ–Α―²–Α, –Ζ–Α –¥–Α –Η–Ζ―¹–Μ–Β–¥–≤–Α ―²–Β–Ψ―Ä–Β―²–Η―΅–Ϋ–Η –Ω―Ä–Ψ–±–Μ–Β–Φ–Η –≤ –Φ–Ψ–Μ–Β–Κ―É–Μ―è―Ä–Ϋ–Α―²–Α –±–Η–Ψ–Μ–Ψ–≥–Η―è. –ö–Ψ–≥–Α―²–Ψ –Β –Ω–Ψ–Κ–Α–Ϋ–Β–Ϋ –Ϋ–Α ―¹―Ä–Β―â–Α, –Ω–Ψ―¹–≤–Β―²–Β–Ϋ–Α –Ϋ–Α –Ϋ–Β–≤―Ä–Ψ–Μ–Ψ–≥–Η―è―²–Α, ―¹–Β ―¹―Ä–Β―â–Α ―¹ –Η–Ζ―¹–Μ–Β–¥–≤–Α–Ϋ–Η―è –Ϋ–Α ―¹―²―Ä―É–Κ―²―É―Ä–Α―²–Α –Ϋ–Α –Φ–Ψ–Ζ―ä–Κ–Α. –û―΅–Α―Ä–Ψ–≤–Α–Ϋ –Ψ―² –Ϋ–Α―É―΅–Β–Ϋ–Ψ―²–Ψ, –Ζ–Α–Ω–Ψ―΅–Ϋ–Α–Μ –¥–Α –Φ–Η―¹–Μ–Η –Ζ–Α –¥–Η–Ϋ–Α–Φ–Η–Κ–Α―²–Α –Ϋ–Α –Ω―Ä–Ψ―¹―²–Η―²–Β –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Η –Φ―Ä–Β–Ε–Η. –ö–Ψ–≥–Α―²–Ψ –Ϋ–Β–≤―Ä–Ψ–Ϋ–Η―²–Β –¥–Β–Ι―¹―²–≤–Α―² –Ζ–Α–Β–¥–Ϋ–Ψ, ―²–Β –Φ–Ψ–≥–Α―² –¥–Α –¥–Ψ–≤–Β–¥–Α―² –¥–Ψ –Ϋ–Ψ–≤–Η –Η –Φ–Ψ―â–Ϋ–Η ―Ö–Α―Ä–Α–Κ―²–Β―Ä–Η―¹―²–Η–Κ–Η, –Κ–Ψ–Η―²–Ψ –Ϋ–Β ―¹–Α –Ψ―΅–Β–≤–Η–¥–Ϋ–Η –Ζ–Α ―΅–Ψ–≤–Β–Κ, –Κ–Ψ–Ι―²–Ψ ―Ä–Α–Ζ–≥–Μ–Β–Ε–¥–Α ―¹–Α–Φ–Ψ –Ψ―²–¥–Β–Μ–Ϋ–Η―²–Β –Κ–Ψ–Φ–Ω–Ψ–Ϋ–Β–Ϋ―²–Η –Ϋ–Α –Φ―Ä–Β–Ε–Α―²–Α.

–ü―Ä–Β–Ζ 1980 –≥. –Ξ–Ψ–Ω―³–Η–Ι–Μ–¥ –Ϋ–Α–Ω―É―¹–Κ–Α ―Ä–Α–±–Ψ―²–Α―²–Α ―¹–Η –≤ –ü―Ä–Η–Ϋ―¹―²―ä–Ϋ―¹–Κ–Η―è ―É–Ϋ–Η–≤–Β―Ä―¹–Η―²–Β―², –Κ―ä–¥–Β―²–Ψ –Η–Ζ―¹–Μ–Β–¥–Ψ–≤–Α―²–Β–Μ―¹–Κ–Η―²–Β –Φ―É –Η–Ϋ―²–Β―Ä–Β―¹–Η –≥–Ψ –Η–Ζ–≤–Β–Ε–¥–Α―² –Η–Ζ–≤―ä–Ϋ –Ψ–±–Μ–Α―¹―²–Η―²–Β, –≤ –Κ–Ψ–Η―²–Ψ ―Ä–Α–±–Ψ―²―è―² –Κ–Ψ–Μ–Β–≥–Η―²–Β –Φ―É –Ω–Ψ ―³–Η–Ζ–Η–Κ–Α, –Η ―¹–Β –Ω―Ä–Β–Φ–Β―¹―²–≤–Α –Ϋ–Α –¥―Ä―É–≥–Η―è –Κ―Ä–Α–Ι –Ϋ–Α –Κ–Ψ–Ϋ―²–Η–Ϋ–Β–Ϋ―²–Α. –Δ–Ψ–Ι –Ω―Ä–Η–Β–Φ–Α –Ω―Ä–Β–¥–Μ–Ψ–Ε–Β–Ϋ–Η–Β―²–Ψ –Ζ–Α –Ω―Ä–Ψ―³–Β―¹–Ψ―Ä―¹–Κ–Α –¥–Μ―ä–Ε–Ϋ–Ψ―¹―² –Ω–Ψ ―Ö–Η–Φ–Η―è –Η –±–Η–Ψ–Μ–Ψ–≥–Η―è –≤ –ö–Α–Μ–Η―³–Ψ―Ä–Ϋ–Η–Ι―¹–Κ–Η―è ―²–Β―Ö–Ϋ–Ψ–Μ–Ψ–≥–Η―΅–Β–Ϋ –Η–Ϋ―¹―²–Η―²―É―² (Caltech) –≤ –ü–Α―¹–Α–¥–Β–Ϋ–Α, –°–Ε–Ϋ–Α –ö–Α–Μ–Η―³–Ψ―Ä–Ϋ–Η―è. –Δ–Α–Φ –Β –Η–Φ–Α–Μ –¥–Ψ―¹―²―ä–Ω –¥–Ψ –Κ–Ψ–Φ–Ω―é―²―ä―Ä–Ϋ–Η ―Ä–Β―¹―É―Ä―¹–Η, –Κ–Ψ–Η―²–Ψ –Β –Φ–Ψ–Ε–Β–Μ –¥–Α –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –Ζ–Α ―¹–≤–Ψ–±–Ψ–¥–Ϋ–Η –Β–Κ―¹–Ω–Β―Ä–Η–Φ–Β–Ϋ―²–Η –Η –¥–Α ―Ä–Α–Ζ–≤–Η–≤–Α –Η–¥–Β–Η―²–Β ―¹–Η –Ζ–Α –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Η―²–Β –Φ―Ä–Β–Ε–Η.

–£―ä–Ω―Ä–Β–Κ–Η ―²–Ψ–≤–Α ―²–Ψ–Ι –Ϋ–Β –Η–Ζ–Ψ―¹―²–Α–≤―è –Ψ―¹–Ϋ–Ψ–≤–Α―²–Α ―¹–Η –≤―ä–≤ ―³–Η–Ζ–Η–Κ–Α―²–Α, –Κ―ä–¥–Β―²–Ψ –Ϋ–Α–Φ–Η―Ä–Α –≤–¥―ä―Ö–Ϋ–Ψ–≤–Β–Ϋ–Η–Β –Ζ–Α ―Ä–Α–Ζ–±–Η―Ä–Α–Ϋ–Β―²–Ψ ―¹–Η –Κ–Α–Κ ―¹–Η―¹―²–Β–Φ–Η ―¹ –Φ–Ϋ–Ψ–≥–Ψ –Φ–Α–Μ–Κ–Η –Κ–Ψ–Φ–Ω–Ψ–Ϋ–Β–Ϋ―²–Η, –Κ–Ψ–Η―²–Ψ ―Ä–Α–±–Ψ―²―è―² –Ζ–Α–Β–¥–Ϋ–Ψ, –Φ–Ψ–≥–Α―² –¥–Α –¥–Ψ–≤–Β–¥–Α―² –¥–Ψ –Ϋ–Ψ–≤–Η –Η –Η–Ϋ―²–Β―Ä–Β―¹–Ϋ–Η ―è–≤–Μ–Β–Ϋ–Η―è. –û―¹–Ψ–±–Β–Ϋ–Ψ –Φ―É –Β –Ω–Ψ–Μ–Β–Ζ–Ϋ–Ψ –¥–Α ―¹–Β –Ζ–Α–Ω–Ψ–Ζ–Ϋ–Α–Β ―¹ –Φ–Α–≥–Ϋ–Η―²–Ϋ–Η―²–Β –Φ–Α―²–Β―Ä–Η–Α–Μ–Η, –Κ–Ψ–Η―²–Ψ –Η–Φ–Α―² ―¹–Ω–Β―Ü–Η–Α–Μ–Ϋ–Η ―Ö–Α―Ä–Α–Κ―²–Β―Ä–Η―¹―²–Η–Κ–Η –±–Μ–Α–≥–Ψ–¥–Α―Ä–Β–Ϋ–Η–Β –Ϋ–Α –Α―²–Ψ–Φ–Ϋ–Η―è ―¹–Η ―¹–Ω–Η–Ϋ - ―¹–≤–Ψ–Ι―¹―²–≤–Ψ, –Κ–Ψ–Β―²–Ψ –Ω―Ä–Β–≤―Ä―ä―â–Α –≤―¹–Β–Κ–Η –Α―²–Ψ–Φ –≤ –Φ–Α–Μ―ä–Κ –Φ–Α–≥–Ϋ–Η―². –Γ–Ω–Η–Ϋ–Ψ–≤–Β―²–Β –Ϋ–Α ―¹―ä―¹–Β–¥–Ϋ–Η―²–Β –Α―²–Ψ–Φ–Η ―¹–Η –≤–Μ–Η―è―è―² –≤–Ζ–Α–Η–Φ–Ϋ–Ψ; ―²–Ψ–≤–Α –Φ–Ψ–Ε–Β –¥–Α –Ω–Ψ–Ζ–≤–Ψ–Μ–Η –Ψ–±―Ä–Α–Ζ―É–≤–Α–Ϋ–Β―²–Ψ –Ϋ–Α –Ψ–±–Μ–Α―¹―²–Η ―¹―ä―¹ ―¹–Ω–Η–Ϋ –≤ –Β–¥–Ϋ–Α –Η ―¹―ä―â–Α –Ω–Ψ―¹–Ψ–Κ–Α. –Δ–Ψ–Ι ―É―¹–Ω―è–≤–Α –¥–Α ―¹―ä–Ζ–¥–Α–¥–Β –Φ–Ψ–¥–Β–Μ –Ϋ–Α –Φ―Ä–Β–Ε–Α ―¹ –≤―ä–Ζ–Μ–Η –Η –≤―Ä―ä–Ζ–Κ–Η, –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α–Ι–Κ–Η ―³–Η–Ζ–Η–Κ–Α―²–Α, –Κ–Ψ―è―²–Ψ –Ψ–Ω–Η―¹–≤–Α –Κ–Α–Κ ―¹–Β ―Ä–Α–Ζ–≤–Η–≤–Α―² –Φ–Α―²–Β―Ä–Η–Α–Μ–Η―²–Β, –Κ–Ψ–≥–Α―²–Ψ ―¹–Ω–Η–Ϋ–Ψ–≤–Β―²–Β ―¹–Η –≤–Μ–Η―è―è―² –Β–¥–Η–Ϋ –Ϋ–Α –¥―Ä―É–≥.

–€―Ä–Β–Ε–Α―²–Α –Ζ–Α–Ω–Α–Ζ–≤–Α –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η―è –≤ –Ω―Ä–Ψ―¹―²―Ä–Α–Ϋ―¹―²–≤–Ψ―²–Ψ –€―Ä–Β–Ε–Α―²–Α, –Η–Ζ–≥―Ä–Α–¥–Β–Ϋ–Α –Ψ―² –Ξ–Ψ–Ω―³–Β–Μ–¥, –Η–Φ–Α –≤―ä–Ζ–Μ–Η, –Κ–Ψ–Η―²–Ψ ―¹–Α ―¹–≤―ä―Ä–Ζ–Α–Ϋ–Η –Ω–Ψ–Φ–Β–Ε–¥―É ―¹–Η ―΅―Ä–Β–Ζ –≤―Ä―ä–Ζ–Κ–Η ―¹ ―Ä–Α–Ζ–Μ–Η―΅–Ϋ–Α ―¹–Η–Μ–Α. –£―¹–Β–Κ–Η –≤―ä–Ζ–Β–Μ –Φ–Ψ–Ε–Β –¥–Α ―¹―ä―Ö―Ä–Α–Ϋ―è–≤–Α –Η–Ϋ–¥–Η–≤–Η–¥―É–Α–Μ–Ϋ–Α ―¹―²–Ψ–Ι–Ϋ–Ψ―¹―² - –≤ –Ω―ä―Ä–≤–Α―²–Α ―Ä–Α–±–Ψ―²–Α –Ϋ–Α –Ξ–Ψ–Ω―³–Β–Μ–¥ ―²―è –Φ–Ψ–Ε–Β –¥–Α –±―ä–¥–Β 0 –Η–Μ–Η 1, –Ω–Ψ–¥–Ψ–±–Ϋ–Ψ –Ϋ–Α –Ω–Η–Κ―¹–Β–Μ–Η―²–Β –≤ ―΅–Β―Ä–Ϋ–Ψ-–±―è–Μ–Α –Κ–Α―Ä―²–Η–Ϋ–Α. –Ξ–Ψ–Ω―³–Β–Μ–¥ –Ψ–Ω–Η―¹–≤–Α ―Ü―è–Μ–Ψ―¹―²–Ϋ–Ψ―²–Ψ ―¹―ä―¹―²–Ψ―è–Ϋ–Η–Β –Ϋ–Α –Φ―Ä–Β–Ε–Α―²–Α ―¹―ä―¹ ―¹–≤–Ψ–Ι―¹―²–≤–Ψ, –Κ–Ψ–Β―²–Ψ –Β –Β–Κ–≤–Η–≤–Α–Μ–Β–Ϋ―²–Ϋ–Ψ –Ϋ–Α –Β–Ϋ–Β―Ä–≥–Η―è―²–Α –≤ ―¹–Η―¹―²–Β–Φ–Α―²–Α –Ψ―² ―¹–Ω–Η–Ϋ–Ψ–≤–Β, –Ψ―²–Κ―Ä–Η―²–Α –≤―ä–≤ ―³–Η–Ζ–Η–Κ–Α―²–Α; –Β–Ϋ–Β―Ä–≥–Η―è―²–Α ―¹–Β –Η–Ζ―΅–Η―¹–Μ―è–≤–Α –Ω–Ψ ―³–Ψ―Ä–Φ―É–Μ–Α, –Κ–Ψ―è―²–Ψ –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –≤―¹–Η―΅–Κ–Η ―¹―²–Ψ–Ι–Ϋ–Ψ―¹―²–Η –Ϋ–Α –≤―ä–Ζ–Μ–Η―²–Β –Η ―¹–Η–Μ–Α―²–Α –Ϋ–Α –≤―Ä―ä–Ζ–Κ–Η―²–Β –Φ–Β–Ε–¥―É ―²―è―Ö. –€―Ä–Β–Ε–Α―²–Α –Ϋ–Α –Ξ–Ψ–Ω―³–Β–Μ–¥ ―¹–Β –Ω―Ä–Ψ–≥―Ä–Α–Φ–Η―Ä–Α ―΅―Ä–Β–Ζ –Ω–Ψ–¥–Α–≤–Α–Ϋ–Β –Ϋ–Α –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η–Β –Κ―ä–Φ –≤―ä–Ζ–Μ–Η―²–Β, –Ϋ–Α –Κ–Ψ–Η―²–Ψ ―¹–Β –Ζ–Α–¥–Α–≤–Α ―¹―²–Ψ–Ι–Ϋ–Ψ―¹―² –Ϋ–Α ―΅–Β―Ä–Ϋ–Ψ (0) –Η–Μ–Η –±―è–Μ–Ψ (1). –Γ–Μ–Β–¥ ―²–Ψ–≤–Α –≤―Ä―ä–Ζ–Κ–Η―²–Β –Ϋ–Α –Φ―Ä–Β–Ε–Α―²–Α ―¹–Β –Κ–Ψ―Ä–Η–≥–Η―Ä–Α―², –Κ–Α―²–Ψ ―¹–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α ―³–Ψ―Ä–Φ―É–Μ–Α―²–Α –Ζ–Α –Β–Ϋ–Β―Ä–≥–Η―è―²–Α, ―²–Α–Κ–Α ―΅–Β –Ζ–Α–Ω–Α–Φ–Β―²–Β–Ϋ–Ψ―²–Ψ –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η–Β –¥–Α –Ω–Ψ–Μ―É―΅–Η –Ϋ–Η―¹–Κ–Α –Β–Ϋ–Β―Ä–≥–Η―è. –ö–Ψ–≥–Α―²–Ψ –≤ –Φ―Ä–Β–Ε–Α―²–Α ―¹–Β –Ω–Ψ–¥–Α–¥–Β –¥―Ä―É–≥ –Ψ–±―Ä–Α–Ζ, –Η–Φ–Α –Ω―Ä–Α–≤–Η–Μ–Ψ –Ζ–Α –Ω―Ä–Β–Φ–Η–Ϋ–Α–≤–Α–Ϋ–Β –Ω―Ä–Β–Ζ –≤―ä–Ζ–Μ–Η―²–Β –Β–¥–Η–Ϋ –Ω–Ψ –Β–¥–Η–Ϋ –Η –Ω―Ä–Ψ–≤–Β―Ä–Κ–Α –¥–Α–Μ–Η –Φ―Ä–Β–Ε–Α―²–Α –Η–Φ–Α –Ω–Ψ-–Ϋ–Η―¹–Κ–Α –Β–Ϋ–Β―Ä–≥–Η―è, –Α–Κ–Ψ ―¹―²–Ψ–Ι–Ϋ–Ψ―¹―²―²–Α –Ϋ–Α ―²–Ψ–Ζ–Η –≤―ä–Ζ–Β–Μ ―¹–Β –Ω―Ä–Ψ–Φ–Β–Ϋ–Η. –ê–Κ–Ψ ―¹–Β –Ψ–Κ–Α–Ε–Β, ―΅–Β –Β–Ϋ–Β―Ä–≥–Η―è―²–Α –Ϋ–Α–Φ–Α–Μ―è–≤–Α, –Α–Κ–Ψ –≤–Φ–Β―¹―²–Ψ ―΅–Β―Ä–Β–Ϋ –Ω–Η–Κ―¹–Β–Μ –Η–Φ–Α –±―è–Μ, ―²–Ψ–Ι –Ω―Ä–Ψ–Φ–Β–Ϋ―è ―Ü–≤–Β―²–Α ―¹–Η. –Δ–Α–Ζ–Η –Ω―Ä–Ψ―Ü–Β–¥―É―Ä–Α –Ω―Ä–Ψ–¥―ä–Μ–Ε–Α–≤–Α, –¥–Ψ–Κ–Α―²–Ψ –Ϋ–Β ―¹―²–Α–Ϋ–Β –Ϋ–Β–≤―ä–Ζ–Φ–Ψ–Ε–Ϋ–Ψ –¥–Α ―¹–Β –Ψ―²–Κ―Ä–Η―è―² –¥–Ψ–Ω―ä–Μ–Ϋ–Η―²–Β–Μ–Ϋ–Η –Ω–Ψ–¥–Ψ–±―Ä–Β–Ϋ–Η―è. –ö–Ψ–≥–Α―²–Ψ ―¹–Β –¥–Ψ―¹―²–Η–≥–Ϋ–Β ―²–Ψ–Ζ–Η –Φ–Ψ–Φ–Β–Ϋ―², –Φ―Ä–Β–Ε–Α―²–Α ―΅–Β―¹―²–Ψ –Β –≤―ä–Ζ–Ω―Ä–Ψ–Η–Ζ–≤–Β–Μ–Α –Ψ―Ä–Η–≥–Η–Ϋ–Α–Μ–Ϋ–Ψ―²–Ψ –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η–Β, –≤―ä―Ä―Ö―É –Κ–Ψ–Β―²–Ψ –Β –±–Η–Μ–Α –Ψ–±―É―΅–Β–Ϋ–Α.

–Δ–Ψ–≤–Α –Φ–Ψ–Ε–Β –¥–Α –Ϋ–Β –Η–Ζ–≥–Μ–Β–Ε–¥–Α ―²–Ψ–Μ–Κ–Ψ–≤–Α –Ζ–Α–±–Β–Μ–Β–Ε–Η―²–Β–Μ–Ϋ–Ψ, –Α–Κ–Ψ ―¹–Β –Ζ–Α–Ω–Α–Φ–Β―²―è–≤–Α ―¹–Α–Φ–Ψ –Β–¥–Η–Ϋ –Φ–Ψ–¥–Β–Μ. –€–Ψ–Ε–Β –±–Η ―¹–Β –Ω–Η―²–Α―²–Β –Ζ–Α―â–Ψ –Ω―Ä–Ψ―¹―²–Ψ –Ϋ–Β ―¹–Β –Ζ–Α–Ω–Α–Ζ–Η ―¹–Α–Φ–Ψ―²–Ψ –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η–Β –Η –¥–Α ―¹–Β ―¹―Ä–Α–≤–Ϋ–Η ―¹ –¥―Ä―É–≥–Ψ ―²–Β―¹―²–≤–Α–Ϋ–Ψ –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η–Β, –Ϋ–Ψ –Φ–Β―²–Ψ–¥―ä―² –Ϋ–Α –Ξ–Ψ–Ω―³–Β–Μ–¥ –Β ―¹–Ω–Β―Ü–Η–Α–Μ–Β–Ϋ, –Ζ–Α―â–Ψ―²–Ψ –Φ–Ψ–≥–Α―² –¥–Α ―¹–Β –Ζ–Α–Ω–Α–Ζ―è―² –Ϋ―è–Κ–Ψ–Μ–Κ–Ψ –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η―è –Β–¥–Ϋ–Ψ–≤―Ä–Β–Φ–Β–Ϋ–Ϋ–Ψ –Η –Φ―Ä–Β–Ε–Α―²–Α –Ψ–±–Η–Κ–Ϋ–Ψ–≤–Β–Ϋ–Ψ –Φ–Ψ–Ε–Β –¥–Α –Ϋ–Α–Ω―Ä–Α–≤–Η ―Ä–Α–Ζ–Μ–Η–Κ–Α –Φ–Β–Ε–¥―É ―²―è―Ö.

–Ξ–Ψ–Ω―³–Β–Μ–¥ –Ψ–Ω―Ä–Η–Μ–Η―΅–Α–≤–Α ―²―ä―Ä―¹–Β–Ϋ–Β―²–Ψ –Ϋ–Α –Ζ–Α–Ω–Α–Ζ–Β–Ϋ–Ψ ―¹―ä―¹―²–Ψ―è–Ϋ–Η–Β –≤ –Φ―Ä–Β–Ε–Α―²–Α –Ϋ–Α ―²―ä―Ä–Κ–Α–Μ―è–Ϋ–Β –Ϋ–Α ―²–Ψ–Ω–Κ–Α –Ω―Ä–Β–Ζ –Ω–Β–Ι–Ζ–Α–Ε –Ψ―² –≤―ä―Ä―Ö–Ψ–≤–Β –Η –¥–Ψ–Μ–Η–Ϋ–Η, ―¹ ―²―Ä–Η–Β–Ϋ–Β, –Κ–Ψ–Β―²–Ψ –Ζ–Α–±–Α–≤―è –¥–≤–Η–Ε–Β–Ϋ–Η–Β―²–Ψ ―ù. –ê–Κ–Ψ ―²–Ψ–Ω–Κ–Α―²–Α –±―ä–¥–Β –Η–Ζ–Ω―É―¹–Ϋ–Α―²–Α –Ϋ–Α –Ψ–Ω―Ä–Β–¥–Β–Μ–Β–Ϋ–Ψ –Φ―è―¹―²–Ψ, ―²―è ―â–Β ―¹–Β ―²―ä―Ä–Κ―É–Μ–Ϋ–Β –≤ –Ϋ–Α–Ι-–±–Μ–Η–Ζ–Κ–Α―²–Α –¥–Ψ–Μ–Η–Ϋ–Α –Η ―â–Β ―¹–Ω―Ä–Β ―²–Α–Φ. –ê–Κ–Ψ –Ϋ–Α –Φ―Ä–Β–Ε–Α―²–Α ―¹–Β –¥–Α–¥–Β –Φ–Ψ–¥–Β–Μ, –Κ–Ψ–Ι―²–Ψ –Β –±–Μ–Η–Ζ―ä–Κ –¥–Ψ –Β–¥–Η–Ϋ –Ψ―² –Ζ–Α–Ω–Α–Ζ–Β–Ϋ–Η―²–Β –Φ–Ψ–¥–Β–Μ–Η, ―²―è –Ω–Ψ ―¹―ä―â–Η―è –Ϋ–Α―΅–Η–Ϋ ―â–Β –Ω―Ä–Ψ–¥―ä–Μ–Ε–Η –¥–Α ―¹–Β –¥–≤–Η–Ε–Η –Ϋ–Α–Ω―Ä–Β–¥, –¥–Ψ–Κ–Α―²–Ψ –Ϋ–Β ―¹–Β –Ψ–Ζ–Ψ–≤–Β –≤ –¥―ä–Ϋ–Ψ―²–Ψ –Ϋ–Α –¥–Ψ–Μ–Η–Ϋ–Α―²–Α –≤ –Β–Ϋ–Β―Ä–≥–Η–Ι–Ϋ–Η―è –Ω–Β–Ι–Ζ–Α–Ε, –Κ–Α―²–Ψ –Ω–Ψ ―²–Ψ–Ζ–Η –Ϋ–Α―΅–Η–Ϋ –Ψ―²–Κ―Ä–Η–Β –Ϋ–Α–Ι-–±–Μ–Η–Ζ–Κ–Η―è –Φ–Ψ–¥–Β–Μ –≤ –Ω–Α–Φ–Β―²―²–Α ―¹–Η.

–€―Ä–Β–Ε–Α―²–Α –Ϋ–Α –Ξ–Ψ–Ω―³–Β–Μ–¥ –Φ–Ψ–Ε–Β –¥–Α ―¹–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –Ζ–Α –Ω―Ä–Β―¹―ä–Ζ–¥–Α–≤–Α–Ϋ–Β –Ϋ–Α –¥–Α–Ϋ–Ϋ–Η, –Κ–Ψ–Η―²–Ψ ―¹―ä–¥―ä―Ä–Ε–Α―² ―à―É–Φ –Η–Μ–Η ―¹–Α –±–Η–Μ–Η ―΅–Α―¹―²–Η―΅–Ϋ–Ψ –Η–Ζ―²―Ä–Η―²–Η.

–Γ–Ω–Ψ–Φ–Β–Ϋ–Η―²–Β ―¹–Β ―¹―ä―Ö―Ä–Α–Ϋ―è–≤–Α―² –≤ ―Ä–Β–Μ–Β―³

–ö―Ä–Β–¥–Η―²:¬†¬© Johan Jarnestad/The Royal Swedish Academy of Sciences

–Ξ–Ψ–Ω―³–Β–Μ–¥ –Η –¥―Ä―É–≥–Η –Ω―Ä–Ψ–¥―ä–Μ–Ε–Α–≤–Α―² –¥–Α ―Ä–Α–Ζ―Ä–Α–±–Ψ―²–≤–Α―² –¥–Β―²–Α–Ι–Μ–Η―²–Β –Ϋ–Α ―³―É–Ϋ–Κ―Ü–Η–Ψ–Ϋ–Η―Ä–Α–Ϋ–Β―²–Ψ –Ϋ–Α –Φ―Ä–Β–Ε–Α―²–Α –Ϋ–Α –Ξ–Ψ–Ω―³–Β–Μ–¥, –≤–Κ–Μ―é―΅–Η―²–Β–Μ–Ϋ–Ψ –≤―ä–Ζ–Μ–Η, –Κ–Ψ–Η―²–Ψ –Φ–Ψ–≥–Α―² –¥–Α ―¹―ä―Ö―Ä–Α–Ϋ―è–≤–Α―² –≤―¹―è–Κ–Α–Κ–≤–Η ―¹―²–Ψ–Ι–Ϋ–Ψ―¹―²–Η, –Α –Ϋ–Β ―¹–Α–Φ–Ψ –Ϋ―É–Μ–Α –Η–Μ–Η –Β–¥–Η–Ϋ–Η―Ü–Α. –ê–Κ–Ψ ―¹–Η –Ω―Ä–Β–¥―¹―²–Α–≤–Η―²–Β –≤―ä–Ζ–Μ–Η―²–Β –Κ–Α―²–Ψ –Ω–Η–Κ―¹–Β–Μ–Η –≤ –Κ–Α―Ä―²–Η–Ϋ–Α, ―²–Β –Φ–Ψ–≥–Α―² –¥–Α –Η–Φ–Α―² ―Ä–Α–Ζ–Μ–Η―΅–Ϋ–Η ―Ü–≤–Β―²–Ψ–≤–Β, –Α –Ϋ–Β ―¹–Α–Φ–Ψ ―΅–Β―Ä–Ϋ–Ψ –Η–Μ–Η –±―è–Μ–Ψ. –Θ―¹―ä–≤―ä―Ä―à–Β–Ϋ―¹―²–≤–Α–Ϋ–Η―²–Β –Φ–Β―²–Ψ–¥–Η –Ω–Ψ–Ζ–≤–Ψ–Μ―è–≤–Α―² –¥–Α ―¹–Β –Ζ–Α–Ω–Α–Ζ–≤–Α―² –Ω–Ψ–≤–Β―΅–Β ―¹–Ϋ–Η–Φ–Κ–Η –Η –¥–Α ―¹–Β –Ω―Ä–Α–≤–Η ―Ä–Α–Ζ–Μ–Η–Κ–Α –Φ–Β–Ε–¥―É ―²―è―Ö, –¥–Ψ―Ä–Η –Κ–Ψ–≥–Α―²–Ψ ―¹–Α –¥–Ψ―¹―²–Α ―¹―Ö–Ψ–¥–Ϋ–Η. –Γ―ä―â–Ψ ―²–Ψ–Μ–Κ–Ψ–≤–Α –≤―ä–Ζ–Φ–Ψ–Ε–Ϋ–Ψ –Β –¥–Α ―¹–Β –Η–¥–Β–Ϋ―²–Η―³–Η―Ü–Η―Ä–Α –Η–Μ–Η ―Ä–Β–Κ–Ψ–Ϋ―¹―²―Ä―É–Η―Ä–Α –Κ–Α–Κ–≤–Α―²–Ψ –Η –¥–Α –Β –Η–Ϋ―³–Ψ―Ä–Φ–Α―Ü–Η―è, –Ω―Ä–Η ―É―¹–Μ–Ψ–≤–Η–Β ―΅–Β ―²―è –Β –Η–Ζ–≥―Ä–Α–¥–Β–Ϋ–Α –Ψ―² –Φ–Ϋ–Ψ–≥–Ψ ―²–Ψ―΅–Κ–Η –¥–Α–Ϋ–Ϋ–Η.

–ö–Μ–Α―¹–Η―³–Η–Κ–Α―Ü–Η―è ―¹ –Ω–Ψ–Φ–Ψ―â―²–Α –Ϋ–Α ―³–Η–Ζ–Η–Κ–Α―²–Α –Ψ―² XIX –≤–Β–Κ

–½–Α–Ω–Ψ–Φ–Ϋ―è–Ϋ–Β―²–Ψ –Ϋ–Α –¥–Α–¥–Β–Ϋ–Ψ –Η–Ζ–Ψ–±―Ä–Α–Ε–Β–Ϋ–Η–Β –Β –Β–¥–Ϋ–Ψ, –Ϋ–Ψ ―²―ä–Μ–Κ―É–≤–Α–Ϋ–Β―²–Ψ –Ϋ–Α ―²–Ψ–≤–Α, –Κ–Ψ–Β―²–Ψ ―²–Ψ –Η–Ζ–Ψ–±―Ä–Α–Ζ―è–≤–Α, –Η–Ζ–Η―¹–Κ–≤–Α –Φ–Α–Μ–Κ–Ψ –Ω–Ψ–≤–Β―΅–Β.

–î–Ψ―Ä–Η –Φ–Ϋ–Ψ–≥–Ψ –Φ–Α–Μ–Κ–Η –¥–Β―Ü–Α –Φ–Ψ–≥–Α―² –¥–Α –Ω–Ψ―¹–Ψ―΅–Α―² ―Ä–Α–Ζ–Μ–Η―΅–Ϋ–Η –Ε–Η–≤–Ψ―²–Ϋ–Η –Η –¥–Α –Κ–Α–Ε–Α―² ―¹ ―É–≤–Β―Ä–Β–Ϋ–Ψ―¹―² –¥–Α–Μ–Η ―²–Ψ–≤–Α –Β –Κ―É―΅–Β, –Κ–Ψ―²–Κ–Α –Η–Μ–Η –Κ–Α―²–Β―Ä–Η―Ü–Α. –ü–Ψ–Ϋ―è–Κ–Ψ–≥–Α –Φ–Ψ–Ε–Β –Η –¥–Α –≥―Ä–Β―à–Α―², –Ϋ–Ψ ―¹―ä–≤―¹–Β–Φ ―¹–Κ–Ψ―Ä–Ψ –Ω–Ψ―΅―²–Η –≤–Η–Ϋ–Α–≥–Η ―¹–Α –Ω―Ä–Α–≤–Η. –î–Β―²–Β―²–Ψ –Φ–Ψ–Ε–Β –¥–Α –Ϋ–Α―É―΅–Η ―²–Ψ–≤–Α –¥–Ψ―Ä–Η –±–Β–Ζ –¥–Α –≤–Η–Ε–¥–Α ―¹―Ö–Β–Φ–Η –Η–Μ–Η –Ψ–±―è―¹–Ϋ–Β–Ϋ–Η―è –Ϋ–Α –Ω–Ψ–Ϋ―è―²–Η―è –Κ–Α―²–Ψ –≤–Η–¥ –Η–Μ–Η –±–Ψ–Ζ–Α–Ι–Ϋ–Η–Κ. –Γ–Μ–Β–¥ –Κ–Α―²–Ψ ―¹–Β ―¹–±–Μ―ä―¹–Κ–Α ―¹ –Ϋ―è–Κ–Ψ–Μ–Κ–Ψ –Ω―Ä–Η–Φ–Β―Ä–Α –Ζ–Α –≤―¹–Β–Κ–Η –≤–Η–¥ –Ε–Η–≤–Ψ―²–Ϋ–Ψ, ―Ä–Α–Ζ–Μ–Η―΅–Ϋ–Η―²–Β –Κ–Α―²–Β–≥–Ψ―Ä–Η–Η ―¹–Β –Ω–Ψ–¥―Ä–Β–Ε–¥–Α―² –≤ –≥–Μ–Α–≤–Α―²–Α –Ϋ–Α –¥–Β―²–Β―²–Ψ. –Ξ–Ψ―Ä–Α―²–Α ―¹–Β –Ϋ–Α―É―΅–Α–≤–Α―² –¥–Α ―Ä–Α–Ζ–Ω–Ψ–Ζ–Ϋ–Α–≤–Α―² –Κ–Ψ―²–Κ–Α, –¥–Α ―Ä–Α–Ζ–±–Η―Ä–Α―² –¥–Α–¥–Β–Ϋ–Α –¥―É–Φ–Α –Η–Μ–Η –¥–Α –≤–Μ–Η–Ζ–Α―² –≤ ―¹―²–Α―è –Η –¥–Α –Ζ–Α–±–Β–Μ―è–Ζ–≤–Α―², ―΅–Β –Ϋ–Β―â–Ψ ―¹–Β –Β –Ω―Ä–Ψ–Φ–Β–Ϋ–Η–Μ–Ψ, –Κ–Α―²–Ψ ―¹–Β –Ζ–Α–Ω–Ψ–Ζ–Ϋ–Α―è―² ―¹―ä―¹ –Ζ–Α–Ψ–±–Η–Κ–Α–Μ―è―â–Α―²–Α –≥–Η ―¹―Ä–Β–¥–Α.

–ö–Ψ–≥–Α―²–Ψ –Ξ–Ψ–Ω―³–Β–Μ–¥ –Ω―É–±–Μ–Η–Κ―É–≤–Α ―¹―²–Α―²–Η―è―²–Α ―¹–Η –Ζ–Α –Α―¹–Ψ―Ü–Η–Α―²–Η–≤–Ϋ–Α―²–Α –Ω–Α–Φ–Β―², –™–Β–Ψ―³―Ä–Η –Ξ–Η–Ϋ―²―ä–Ϋ ―Ä–Α–±–Ψ―²–Η –≤ ―É–Ϋ–Η–≤–Β―Ä―¹–Η―²–Β―²–Α βÄû–ö–Α―Ä–Ϋ–Β–≥–Η –€–Β–Μ―ä–ΫβÄ€ –≤ –ü–Η―²―¹–±―ä―Ä–≥, –Γ–ê–©. –ü―Ä–Β–¥–Η ―²–Ψ–≤–Α ―²–Ψ–Ι –Β –Η–Ζ―É―΅–Α–≤–Α–Μ –Β–Κ―¹–Ω–Β―Ä–Η–Φ–Β–Ϋ―²–Α–Μ–Ϋ–Α –Ω―¹–Η―Ö–Ψ–Μ–Ψ–≥–Η―è –Η –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ –Η–Ϋ―²–Β–Μ–Β–Κ―² –≤ –ê–Ϋ–≥–Μ–Η―è –Η –®–Ψ―²–Μ–Α–Ϋ–¥–Η―è –Η ―¹–Β –Β –Η–Ϋ―²–Β―Ä–Β―¹―É–≤–Α–Μ –¥–Α–Μ–Η –Φ–Α―à–Η–Ϋ–Η―²–Β –Φ–Ψ–≥–Α―² –¥–Α ―¹–Β –Ϋ–Α―É―΅–Α―² –¥–Α –Ψ–±―Ä–Α–±–Ψ―²–≤–Α―² –Φ–Ψ–¥–Β–Μ–Η –Ω–Ψ –Ω–Ψ–¥–Ψ–±–Β–Ϋ –Ϋ–Α ―Ö–Ψ―Ä–Α―²–Α –Ϋ–Α―΅–Η–Ϋ, –Ψ―²–Κ―Ä–Η–≤–Α–Ι–Κ–Η ―¹–≤–Ψ–Η ―¹–Ψ–±―¹―²–≤–Β–Ϋ–Η –Κ–Α―²–Β–≥–Ψ―Ä–Η–Η –Ζ–Α ―¹–Ψ―Ä―²–Η―Ä–Α–Ϋ–Β –Η –Η–Ϋ―²–Β―Ä–Ω―Ä–Β―²–Η―Ä–Α–Ϋ–Β –Ϋ–Α –Η–Ϋ―³–Ψ―Ä–Φ–Α―Ü–Η―è―²–Α. –½–Α–Β–¥–Ϋ–Ψ ―¹ –Κ–Ψ–Μ–Β–≥–Α―²–Α ―¹–Η –Δ–Β―Ä―ä–Ϋ―¹ –Γ–Β–Ι–Ϋ–Ψ–≤―¹–Κ–Η (Terrence Sejnowski) –Ξ–Η–Ϋ―²―ä–Ϋ –Η–Ζ―Ö–Ψ–Ε–¥–Α –Ψ―² –Φ―Ä–Β–Ε–Α―²–Α –Ϋ–Α –Ξ–Ψ–Ω―³–Β–Μ–¥ –Η ―è ―Ä–Α–Ζ―à–Η―Ä―è–≤–Α, –Ζ–Α –¥–Α –Η–Ζ–≥―Ä–Α–¥–Η –Ϋ–Β―â–Ψ –Ϋ–Ψ–≤–Ψ, –Κ–Α―²–Ψ –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –Η–¥–Β–Η –Ψ―² ―¹―²–Α―²–Η―¹―²–Η―΅–Β―¹–Κ–Α―²–Α ―³–Η–Ζ–Η–Κ–Α.

–Γ―²–Α―²–Η―¹―²–Η―΅–Β―¹–Κ–Α―²–Α ―³–Η–Ζ–Η–Κ–Α –Ψ–Ω–Η―¹–≤–Α ―¹–Η―¹―²–Β–Φ–Η, –Κ–Ψ–Η―²–Ψ ―¹–Β ―¹―ä―¹―²–Ψ―è―² –Ψ―² –Φ–Ϋ–Ψ–≥–Ψ ―¹―Ö–Ψ–¥–Ϋ–Η –Β–Μ–Β–Φ–Β–Ϋ―²–Η, –Κ–Α―²–Ψ –Ϋ–Α–Ω―Ä–Η–Φ–Β―Ä –Φ–Ψ–Μ–Β–Κ―É–Μ–Η –≤ –≥–Α–Ζ. –Δ―Ä―É–¥–Ϋ–Ψ –Β –Η–Μ–Η –Β –Ϋ–Β–≤―ä–Ζ–Φ–Ψ–Ε–Ϋ–Ψ –¥–Α ―¹–Β –Ω―Ä–Ψ―¹–Μ–Β–¥―è―² –≤―¹–Η―΅–Κ–Η –Ψ―²–¥–Β–Μ–Ϋ–Η –Φ–Ψ–Μ–Β–Κ―É–Μ–Η –≤ –≥–Α–Ζ–Α, –Ϋ–Ψ –Β –≤―ä–Ζ–Φ–Ψ–Ε–Ϋ–Ψ –¥–Α ―¹–Β ―Ä–Α–Ζ–≥–Μ–Β–¥–Α―² –Ζ–Α–Β–¥–Ϋ–Ψ, –Ζ–Α –¥–Α ―¹–Β –Ψ–Ω―Ä–Β–¥–Β–Μ―è―² –Ψ–±―â–Η―²–Β ―¹–≤–Ψ–Ι―¹―²–≤–Α –Ϋ–Α –≥–Α–Ζ–Α, –Κ–Α―²–Ψ –Ϋ–Α–Ω―Ä–Η–Φ–Β―Ä –Ϋ–Α–Μ―è–≥–Α–Ϋ–Β –Η–Μ–Η ―²–Β–Φ–Ω–Β―Ä–Α―²―É―Ä–Α. –Γ―ä―â–Β―¹―²–≤―É–≤–Α―² –Φ–Ϋ–Ψ–≥–Ψ –Ω–Ψ―²–Β–Ϋ―Ü–Η–Α–Μ–Ϋ–Η –Ϋ–Α―΅–Η–Ϋ–Η –Φ–Ψ–Μ–Β–Κ―É–Μ–Η―²–Β –Ϋ–Α –≥–Α–Ζ–Α –¥–Α ―¹–Β ―Ä–Α–Ζ–Ω―Ä–Ψ―¹―²―Ä–Α–Ϋ―è–≤–Α―² –≤ –Ψ–±–Β–Φ–Α –Φ―É ―¹ –Η–Ϋ–¥–Η–≤–Η–¥―É–Α–Μ–Ϋ–Η ―¹–Κ–Ψ―Ä–Ψ―¹―²–Η –Η –≤―ä–Ω―Ä–Β–Κ–Η ―²–Ψ–≤–Α –¥–Α –≤–Ψ–¥―è―² –¥–Ψ ―¹―ä―â–Η―²–Β –Κ–Ψ–Μ–Β–Κ―²–Η–≤–Ϋ–Η ―¹–≤–Ψ–Ι―¹―²–≤–Α.

–Γ―ä―¹―²–Ψ―è–Ϋ–Η―è―²–Α, –≤ –Κ–Ψ–Η―²–Ψ –Ψ―²–¥–Β–Μ–Ϋ–Η―²–Β –Κ–Ψ–Φ–Ω–Ψ–Ϋ–Β–Ϋ―²–Η –Φ–Ψ–≥–Α―² –¥–Α ―¹―ä―â–Β―¹―²–≤―É–≤–Α―² ―¹―ä–≤–Φ–Β―¹―²–Ϋ–Ψ, –Φ–Ψ–≥–Α―² –¥–Α –±―ä–¥–Α―² –Α–Ϋ–Α–Μ–Η–Ζ–Η―Ä–Α–Ϋ–Η ―¹ –Ω–Ψ–Φ–Ψ―â―²–Α –Ϋ–Α ―¹―²–Α―²–Η―¹―²–Η―΅–Β―¹–Κ–Α―²–Α ―³–Η–Ζ–Η–Κ–Α –Η –¥–Α ―¹–Β –Η–Ζ―΅–Η―¹–Μ–Η –≤–Β―Ä–Ψ―è―²–Ϋ–Ψ―¹―²―²–Α –Ζ–Α ―²―è―Ö–Ϋ–Ψ―²–Ψ –Ϋ–Α―¹―²―ä–Ω–≤–Α–Ϋ–Β. –ù―è–Κ–Ψ–Η ―¹―ä―¹―²–Ψ―è–Ϋ–Η―è ―¹–Α –Ω–Ψ-–≤–Β―Ä–Ψ―è―²–Ϋ–Η –Ψ―² –¥―Ä―É–≥–Η; ―²–Ψ–≤–Α –Ζ–Α–≤–Η―¹–Η –Ψ―² –Κ–Ψ–Μ–Η―΅–Β―¹―²–≤–Ψ―²–Ψ –Ϋ–Α–Μ–Η―΅–Ϋ–Α –Β–Ϋ–Β―Ä–≥–Η―è, –Κ–Ψ–Β―²–Ψ –Β –Ψ–Ω–Η―¹–Α–Ϋ–Ψ –≤ ―É―Ä–Α–≤–Ϋ–Β–Ϋ–Η–Β―²–Ψ –Ϋ–Α ―³–Η–Ζ–Η–Κ–Α –Ψ―² XIX –≤–Β–Κ –¦―É–¥–≤–Η–≥ –ë–Ψ–Μ―Ü–Φ–Α–Ϋ. –€―Ä–Β–Ε–Α―²–Α –Ϋ–Α –Ξ–Η–Ϋ―²―ä–Ϋ –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α ―²–Ψ–≤–Α ―É―Ä–Α–≤–Ϋ–Β–Ϋ–Η–Β, –Α –Φ–Β―²–Ψ–¥―ä―² –Β –Ω―É–±–Μ–Η–Κ―É–≤–Α–Ϋ –Ω―Ä–Β–Ζ 1985 –≥. –Ω–Ψ–¥ –≤–Ω–Β―΅–Α―²–Μ―è–≤–Α―â–Ψ―²–Ψ –Η–Φ–Β βÄû–Φ–Α―à–Η–Ϋ–Α –Ϋ–Α –ë–Ψ–Μ―Ü–Φ–Α–ΫβÄ€.

–†–Α–Ζ–Ω–Ψ–Ζ–Ϋ–Α–≤–Α–Ϋ–Β –Ϋ–Α –Ϋ–Ψ–≤–Η –Ω―Ä–Η–Φ–Β―Ä–Η –Ψ―² ―¹―ä―â–Η―è ―²–Η–Ω

–€–Α―à–Η–Ϋ–Α―²–Α –Ϋ–Α –ë–Ψ–Μ―Ü–Φ–Α–Ϋ –Ψ–±–Η–Κ–Ϋ–Ψ–≤–Β–Ϋ–Ψ ―¹–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α ―¹ –¥–≤–Α ―Ä–Α–Ζ–Μ–Η―΅–Ϋ–Η ―²–Η–Ω–Α –≤―ä–Ζ–Μ–Η. –‰–Ϋ―³–Ψ―Ä–Φ–Α―Ü–Η―è―²–Α ―¹–Β –Ω–Ψ–¥–Α–≤–Α –Κ―ä–Φ –Β–¥–Ϋ–Α –≥―Ä―É–Ω–Α, –Ϋ–Α―Ä–Β―΅–Β–Ϋ–Α –≤–Η–¥–Η–Φ–Η –≤―ä–Ζ–Μ–Η. –î―Ä―É–≥–Η―²–Β –≤―ä–Ζ–Μ–Η –Ψ–±―Ä–Α–Ζ―É–≤–Α―² ―¹–Κ―Ä–Η―² ―¹–Μ–Ψ–Ι. –Γ―²–Ψ–Ι–Ϋ–Ψ―¹―²–Η―²–Β –Η –≤―Ä―ä–Ζ–Κ–Η―²–Β –Ϋ–Α ―¹–Κ―Ä–Η―²–Η―²–Β –≤―ä–Ζ–Μ–Η ―¹―ä―â–Ψ –¥–Ψ–Ω―Ä–Η–Ϋ–Α―¹―è―² –Ζ–Α –Β–Ϋ–Β―Ä–≥–Η―è―²–Α –Ϋ–Α –Φ―Ä–Β–Ε–Α―²–Α –Κ–Α―²–Ψ ―Ü―è–Μ–Ψ.

–€–Α―à–Η–Ϋ–Α―²–Α ―¹–Β ―É–Ω―Ä–Α–≤–Μ―è–≤–Α ―΅―Ä–Β–Ζ –Ω―Ä–Η–Μ–Α–≥–Α–Ϋ–Β –Ϋ–Α –Ω―Ä–Α–≤–Η–Μ–Ψ –Ζ–Α –Α–Κ―²―É–Α–Μ–Η–Ζ–Η―Ä–Α–Ϋ–Β –Ϋ–Α ―¹―²–Ψ–Ι–Ϋ–Ψ―¹―²–Η―²–Β –Ϋ–Α –≤―ä–Ζ–Μ–Η―²–Β –Β–¥–Η–Ϋ –Ω–Ψ –Β–¥–Η–Ϋ. –£ –Κ―Ä–Α–Ι–Ϋ–Α ―¹–Φ–Β―²–Κ–Α –Φ–Α―à–Η–Ϋ–Α―²–Α ―â–Β –Ϋ–Α–≤–Μ–Β–Ζ–Β –≤ ―¹―ä―¹―²–Ψ―è–Ϋ–Η–Β, –≤ –Κ–Ψ–Β―²–Ψ –Φ–Ψ–¥–Β–Μ―ä―² –Ϋ–Α –≤―ä–Ζ–Μ–Η―²–Β –Φ–Ψ–Ε–Β –¥–Α ―¹–Β –Ω―Ä–Ψ–Φ–Β–Ϋ―è, –Ϋ–Ψ ―¹–≤–Ψ–Ι―¹―²–≤–Α―²–Α –Ϋ–Α –Φ―Ä–Β–Ε–Α―²–Α –Κ–Α―²–Ψ ―Ü―è–Μ–Ψ –Ψ―¹―²–Α–≤–Α―² ―¹―ä―â–Η―²–Β. –Δ–Ψ–≥–Α–≤–Α –≤―¹–Β–Κ–Η –≤―ä–Ζ–Φ–Ψ–Ε–Β–Ϋ –Φ–Ψ–¥–Β–Μ ―â–Β –Η–Φ–Α –Ψ–Ω―Ä–Β–¥–Β–Μ–Β–Ϋ–Α –≤–Β―Ä–Ψ―è―²–Ϋ–Ψ―¹―², –Κ–Ψ―è―²–Ψ ―¹–Β –Ψ–Ω―Ä–Β–¥–Β–Μ―è –Ψ―² –Β–Ϋ–Β―Ä–≥–Η―è―²–Α –Ϋ–Α –Φ―Ä–Β–Ε–Α―²–Α –≤ ―¹―ä–Ψ―²–≤–Β―²―¹―²–≤–Η–Β ―¹ ―É―Ä–Α–≤–Ϋ–Β–Ϋ–Η–Β―²–Ψ –Ϋ–Α –ë–Ψ–Μ―Ü–Φ–Α–Ϋ. –ö–Ψ–≥–Α―²–Ψ –Φ–Α―à–Η–Ϋ–Α―²–Α ―¹–Ω―Ä–Β, ―²―è –Β ―¹―ä–Ζ–¥–Α–Μ–Α –Ϋ–Ψ–≤ –Φ–Ψ–¥–Β–Μ, –Κ–Ψ–Β―²–Ψ –Ω―Ä–Α–≤–Η –Φ–Α―à–Η–Ϋ–Α―²–Α –Ϋ–Α –ë–Ψ–Μ―Ü–Φ–Α–Ϋ ―Ä–Α–Ϋ–Β–Ϋ –Ω―Ä–Η–Φ–Β―Ä –Ζ–Α –≥–Β–Ϋ–Β―Ä–Α―²–Η–≤–Β–Ϋ ―Ä–Β–Ε–Η–Φ.

–†–Α–Ζ–Μ–Η―΅–Ϋ–Η –≤–Η–¥–Ψ–≤–Β –Φ―Ä–Β–Ε–Η

| –€–†–ï–•–ê –ù–ê –Ξ–û–ü–Λ–‰–¦–î | –€–ê–®–‰–ù–ê –ù–ê –ë–û–¦–Π–€–ê–ù | –û–™–†–ê–ù–‰–ß–ï–ù–ê –€–ê–®–‰–ù–ê –ù–ê –ë–û–¦–Π–€–ê–ù |

|---|---|---|

|

||

|

–ê―¹–Ψ―Ü–Η–Α―²–Η–≤–Ϋ–Α―²–Α –Ω–Α–Φ–Β―² –Ϋ–Α –î–Ε–Ψ–Ϋ –Ξ–Ψ–Ω―³–Η–Ι–Μ–¥ –Β –Η–Ζ–≥―Ä–Α–¥–Β–Ϋ–Α ―²–Α–Κ–Α, ―΅–Β –≤―¹–Η―΅–Κ–Η –≤―ä–Ζ–Μ–Η ―¹–Α ―¹–≤―ä―Ä–Ζ–Α–Ϋ–Η –Ω–Ψ–Φ–Β–Ε–¥―É ―¹–Η. –‰–Ϋ―³–Ψ―Ä–Φ–Α―Ü–Η―è―²–Α ―¹–Β –Ω–Ψ–¥–Α–≤–Α –Η¬†―¹–Β ―΅–Β―²–Β –Ψ―² –≤―¹–Η―΅–Κ–Η –≤―ä–Ζ–Μ–Η. |

–€–Α―à–Η–Ϋ–Α―²–Α –Ϋ–Α –ë–Ψ–Μ―Ü–Φ–Α–Ϋ –Ϋ–Α –î–Ε–Β―³―Ä–Η –Ξ–Η–Ϋ―²―ä–Ϋ ―΅–Β―¹―²–Ψ ―¹–Β –Η–Ζ–≥―Ä–Α–Ε–¥–Α –Ϋ–Α –¥–≤–Α ―¹–Μ–Ψ―è, –Ω―Ä–Η –Κ–Ψ–Β―²–Ψ –Η–Ϋ―³–Ψ―Ä–Φ–Α―Ü–Η―è―²–Α ―¹–Β –Ω–Ψ–¥–Α–≤–Α –Η ―Ä–Α–Ζ―΅–Η―²–Α ―¹ –Ω–Ψ–Φ–Ψ―â―²–Α –Ϋ–Α ―¹–Μ–Ψ–Ι –Ψ―² –≤–Η–¥–Η–Φ–Η –≤―ä–Ζ–Μ–Η. –Δ–Β ―¹–Α ―¹–≤―ä―Ä–Ζ–Α–Ϋ–Η ―¹―ä―¹ ―¹–Κ―Ä–Η―²–Η –≤―ä–Ζ–Μ–Η, –Κ–Ψ–Η―²–Ψ –≤–Μ–Η―è―è―² –≤―ä―Ä―Ö―É –Ϋ–Α―΅–Η–Ϋ–Α, –Ω–Ψ –Κ–Ψ–Ι―²–Ψ –Φ―Ä–Β–Ε–Α―²–Α ―³―É–Ϋ–Κ―Ü–Η–Ψ–Ϋ–Η―Ä–Α –≤ ―¹–≤–Ψ―è―²–Α ―Ü―è–Μ–Ψ―¹―². | –£ –Ψ–≥―Ä–Α–Ϋ–Η―΅–Β–Ϋ–Α―²–Α –Φ–Α―à–Η–Ϋ–Α –Ϋ–Α –ë–Ψ–Μ―Ü–Φ–Α–Ϋ –Ϋ―è–Φ–Α –≤―Ä―ä–Ζ–Κ–Η –Φ–Β–Ε–¥―É –≤―ä–Ζ–Μ–Η―²–Β –≤ –Β–¥–Η–Ϋ –Η ―¹―ä―â–Η ―¹–Μ–Ψ–Ι. –€–Α―à–Η–Ϋ–Η―²–Β ―΅–Β―¹―²–Ψ ―¹–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α―² –≤―ä–≤ –≤–Β―Ä–Η–≥–Α, –Β–¥–Ϋ–Α ―¹–Μ–Β–¥ –¥―Ä―É–≥–Α. –Γ–Μ–Β–¥ –Κ–Α―²–Ψ ―¹–Β –Ψ–±―É―΅–Η –Ω―ä―Ä–≤–Α―²–Α –Ψ–≥―Ä–Α–Ϋ–Η―΅–Β–Ϋ–Α –Φ–Α―à–Η–Ϋ–Α –Ϋ–Α –ë–Ψ–Μ―Ü–Φ–Α–Ϋ, ―¹―ä–¥―ä―Ä–Ε–Α–Ϋ–Η–Β―²–Ψ –Ϋ–Α ―¹–Κ―Ä–Η―²–Η―²–Β –≤―ä–Ζ–Μ–Η ―¹–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –Ζ–Α –Ψ–±―É―΅–Β–Ϋ–Η–Β –Ϋ–Α ―¹–Μ–Β–¥–≤–Α―â–Α―²–Α –Φ–Α―à–Η–Ϋ–Α –Η ―².–Ϋ. |

–ö―Ä–Β–¥–Η―²:¬†¬© Johan Jarnestad/The Royal Swedish Academy of Sciences

–€–Α―à–Η–Ϋ–Α―²–Α –Ϋ–Α –ë–Ψ–Μ―Ü–Φ–Α–Ϋ –Φ–Ψ–Ε–Β –¥–Α ―¹–Β ―É―΅–Η - –Ϋ–Β –Ψ―² –Η–Ϋ―¹―²―Ä―É–Κ―Ü–Η–Η, –Α –Ψ―² –¥–Α–¥–Β–Ϋ–Η –Ω―Ä–Η–Φ–Β―Ä–Η. –Δ―è ―¹–Β –Ψ–±―É―΅–Α–≤–Α, –Κ–Α―²–Ψ ―¹–Β –Α–Κ―²―É–Α–Μ–Η–Ζ–Η―Ä–Α―² ―¹―²–Ψ–Ι–Ϋ–Ψ―¹―²–Η―²–Β –≤ –Φ―Ä–Β–Ε–Ψ–≤–Η―²–Β –≤―Ä―ä–Ζ–Κ–Η, ―²–Α–Κ–Α ―΅–Β –Ω―Ä–Η–Φ–Β―Ä–Ϋ–Η―²–Β –Φ–Ψ–¥–Β–Μ–Η, –Κ–Ψ–Η―²–Ψ ―¹–Α –±–Η–Μ–Η –Ω–Ψ–¥–Α–¥–Β–Ϋ–Η –Ϋ–Α –≤–Η–¥–Η–Φ–Η―²–Β –≤―ä–Ζ–Μ–Η –Ω―Ä–Η –Ψ–±―É―΅–Β–Ϋ–Η–Β―²–Ψ, –¥–Α –Η–Φ–Α―² –≤―ä–Ζ–Φ–Ψ–Ε–Ϋ–Ψ –Ϋ–Α–Ι-–≥–Ψ–Μ―è–Φ–Α –≤–Β―Ä–Ψ―è―²–Ϋ–Ψ―¹―² –¥–Α ―¹–Β –Ω–Ψ―è–≤―è―², –Κ–Ψ–≥–Α―²–Ψ –±―ä–¥–Β –Ω―É―¹–Ϋ–Α―²–Α –Φ–Α―à–Η–Ϋ–Α―²–Α. –ê–Κ–Ψ –Β–¥–Η–Ϋ –Η ―¹―ä―â –Φ–Ψ–¥–Β–Μ ―¹–Β –Ω–Ψ–≤―²–Ψ―Ä–Η –Ϋ―è–Κ–Ψ–Μ–Κ–Ψ –Ω―ä―²–Η –Ω–Ψ –≤―Ä–Β–Φ–Β –Ϋ–Α ―²–Ψ–≤–Α –Ψ–±―É―΅–Β–Ϋ–Η–Β, –≤–Β―Ä–Ψ―è―²–Ϋ–Ψ―¹―²―²–Α –Ζ–Α ―²–Ψ–Ζ–Η –Φ–Ψ–¥–Β–Μ –Β –Ψ―â–Β –Ω–Ψ-–≤–Η―¹–Ψ–Κ–Α. –û–±―É―΅–Β–Ϋ–Η–Β―²–Ψ –≤–Μ–Η―è–Β –Η –≤―ä―Ä―Ö―É –≤–Β―Ä–Ψ―è―²–Ϋ–Ψ―¹―²―²–Α –Ζ–Α –Η–Ζ–≤–Β–Ε–¥–Α–Ϋ–Β –Ϋ–Α –Ϋ–Ψ–≤–Η –Φ–Ψ–¥–Β–Μ–Η, –Κ–Ψ–Η―²–Ψ –Ω―Ä–Η–Μ–Η―΅–Α―² –Ϋ–Α –Ω―Ä–Η–Φ–Β―Ä–Η―²–Β, –≤―ä―Ä―Ö―É –Κ–Ψ–Η―²–Ψ –Β –±–Η–Μ–Α –Ψ–±―É―΅–Β–Ϋ–Α –Φ–Α―à–Η–Ϋ–Α―²–Α. –û–±―É―΅–Β–Ϋ–Α―²–Α –Φ–Α―à–Η–Ϋ–Α –Ϋ–Α –ë–Ψ–Μ―Ü–Φ–Α–Ϋ –Φ–Ψ–Ε–Β –¥–Α ―Ä–Α–Ζ–Ω–Ψ–Ζ–Ϋ–Α–≤–Α –Ω–Ψ–Ζ–Ϋ–Α―²–Η ―΅–Β―Ä―²–Η –≤ –Η–Ϋ―³–Ψ―Ä–Φ–Α―Ü–Η―è, –Κ–Ψ―è―²–Ψ –Ϋ–Β –Β –≤–Η–Ε–¥–Α–Μ–Α –Ω―Ä–Β–¥–Η ―²–Ψ–≤–Α. –ü―Ä–Β–¥―¹―²–Α–≤–Β―²–Β ―¹–Η, ―΅–Β ―¹―Ä–Β―â–Ϋ–Β―²–Β –±―Ä–Α―² –Η–Μ–Η ―¹–Β―¹―²―Ä–Α –Ϋ–Α –Ω―Ä–Η―è―²–Β–Μ, –Η –≤–Β–¥–Ϋ–Α–≥–Α –Φ–Ψ–Ε–Β―²–Β –¥–Α –≤–Η–¥–Η―²–Β, ―΅–Β ―²–Β ―²―Ä―è–±–≤–Α –¥–Α ―¹–Α ―Ä–Ψ–¥–Ϋ–Η–Ϋ–Η. –ü–Ψ –Ω–Ψ–¥–Ψ–±–Β–Ϋ –Ϋ–Α―΅–Η–Ϋ –Φ–Α―à–Η–Ϋ–Α―²–Α –Ϋ–Α –ë–Ψ–Μ―Ü–Φ–Α–Ϋ –Φ–Ψ–Ε–Β –¥–Α ―Ä–Α–Ζ–Ω–Ψ–Ζ–Ϋ–Α–Β –Ϋ–Α–Ω―ä–Μ–Ϋ–Ψ –Ϋ–Ψ–≤ –Ω―Ä–Η–Φ–Β―Ä, –Α–Κ–Ψ ―²–Ψ–Ι –Ω―Ä–Η–Ϋ–Α–¥–Μ–Β–Ε–Η –Κ―ä–Φ –Κ–Α―²–Β–≥–Ψ―Ä–Η―è, –Ψ―²–Κ―Ä–Η―²–Α –≤ –Ψ–±―É―΅–Α–≤–Α―â–Η―è –Φ–Α―²–Β―Ä–Η–Α–Μ, –Η –¥–Α –≥–Ψ ―Ä–Α–Ζ–≥―Ä–Α–Ϋ–Η―΅–Η –Ψ―² –Φ–Α―²–Β―Ä–Η–Α–Μ, –Κ–Ψ–Ι―²–Ψ –Ϋ–Β –Β ―¹―Ö–Ψ–¥–Β–Ϋ.

–£ –Ω―ä―Ä–≤–Ψ–Ϋ–Α―΅–Α–Μ–Ϋ–Η―è ―¹–Η –≤–Η–¥ –Φ–Α―à–Η–Ϋ–Α―²–Α –Ϋ–Α –ë–Ψ–Μ―Ü–Φ–Α–Ϋ –Β –¥–Ψ―¹―²–Α –Ϋ–Β–Κ–Ψ–Φ–Ω–Β―²–Β–Ϋ―²–Ϋ–Α –Η –Ι –Β –Ϋ–Β–Ψ–±―Ö–Ψ–¥–Η–Φ–Ψ –Φ–Ϋ–Ψ–≥–Ψ –≤―Ä–Β–Φ–Β, –Ζ–Α –¥–Α –Ϋ–Α–Φ–Β―Ä–Η ―Ä–Β―à–Β–Ϋ–Η―è.

–ù–Β―â–Α―²–Α ―¹―²–Α–≤–Α―² –Ω–Ψ-–Η–Ϋ―²–Β―Ä–Β―¹–Ϋ–Η, –Κ–Ψ–≥–Α―²–Ψ ―²―è ―¹–Β ―Ä–Α–Ζ–≤–Η–≤–Α –Ω–Ψ ―Ä–Α–Ζ–Μ–Η―΅–Ϋ–Η –Ϋ–Α―΅–Η–Ϋ–Η, –Κ–Ψ–Η―²–Ψ –Ξ–Η–Ϋ―²―ä–Ϋ –Ω―Ä–Ψ–¥―ä–Μ–Ε–Α–≤–Α –¥–Α –Η–Ζ―¹–Μ–Β–¥–≤–Α. –ü–Ψ-–Κ―ä―¹–Ϋ–Η―²–Β –≤–Β―Ä―¹–Η–Η ―¹–Α ―Ä–Α–Ζ―Ä–Β–¥–Β–Ϋ–Η, ―²―ä–Ι –Κ–Α―²–Ψ –≤―Ä―ä–Ζ–Κ–Η―²–Β –Φ–Β–Ε–¥―É –Ϋ―è–Κ–Ψ–Η –Ψ―² –Ζ–≤–Β–Ϋ–Α―²–Α ―¹–Α –Ω―Ä–Β–Φ–Α―Ö–Ϋ–Α―²–Η. –û–Κ–Α–Ζ–≤–Α ―¹–Β, ―΅–Β ―²–Ψ–≤–Α –Φ–Ψ–Ε–Β –¥–Α –Ϋ–Α–Ω―Ä–Α–≤–Η –Φ–Α―à–Η–Ϋ–Α―²–Α –Ω–Ψ-–Β―³–Β–Κ―²–Η–≤–Ϋ–Α.

–ü―Ä–Β–Ζ 90-―²–Β –≥–Ψ–¥–Η–Ϋ–Η –Ϋ–Α –Ξ–Ξ –≤–Β–Κ –Φ–Ϋ–Ψ–≥–Ψ –Η–Ζ―¹–Μ–Β–¥–Ψ–≤–Α―²–Β–Μ–Η –≥―É–±―è―² –Η–Ϋ―²–Β―Ä–Β―¹ –Κ―ä–Φ –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Η―²–Β –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Η –Φ―Ä–Β–Ε–Η, –Ϋ–Ψ –Ξ–Η–Ϋ―²―ä–Ϋ –Β –Β–¥–Η–Ϋ –Ψ―² ―²–Β–Ζ–Η, –Κ–Ψ–Η―²–Ψ –Ω―Ä–Ψ–¥―ä–Μ–Ε–Α–≤–Α―² –¥–Α ―Ä–Α–±–Ψ―²―è―² –≤ ―²–Α–Ζ–Η –Ψ–±–Μ–Α―¹―². –Δ–Ψ–Ι ―¹―ä―â–Ψ ―²–Α–Κ–Α –Ω–Ψ–Φ–Α–≥–Α –Ζ–Α –Ζ–Α–Ω–Ψ―΅–≤–Α–Ϋ–Β―²–Ψ –Ϋ–Α –Ϋ–Ψ–≤ –±―É–Φ –Ϋ–Α –≤―ä–Μ–Ϋ―É–≤–Α―â–Η ―Ä–Β–Ζ―É–Μ―²–Α―²–Η; –Ω―Ä–Β–Ζ 2006 –≥. ―²–Ψ–Ι –Η –Κ–Ψ–Μ–Β–≥–Η―²–Β –Φ―É –Γ–Α–Ι–Φ―ä–Ϋ –û―¹–Η–Ϋ–¥–Β―Ä–Ψ (Simon Osindero), –ô–Β―É–Η –Δ–Β―Ö (Yee Whye Teh) –Η –†―É―¹–Μ–Α–Ϋ –Γ–Α–Μ–Α―Ö―É―²–¥–Η–Ϋ–Ψ–≤ (Ruslan Salakhutdinov) ―Ä–Α–Ζ―Ä–Α–±–Ψ―²–≤–Α―² –Φ–Β―²–Ψ–¥ –Ζ–Α –Ω―Ä–Β–¥–≤–Α―Ä–Η―²–Β–Μ–Ϋ–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β –Ϋ–Α –Φ―Ä–Β–Ε–Α ―¹ –Ω–Ψ―Ä–Β–¥–Η―Ü–Α –Ψ―² –Φ–Α―à–Η–Ϋ–Η –Ϋ–Α –ë–Ψ–Μ―Ü–Φ–Α–Ϋ –≤ ―¹–Μ–Ψ–Β–≤–Β, –Β–¥–Η–Ϋ –≤―ä―Ä―Ö―É –¥―Ä―É–≥. –Δ–Ψ–≤–Α –Ω―Ä–Β–¥–≤–Α―Ä–Η―²–Β–Μ–Ϋ–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β –¥–Α–≤–Α –Ϋ–Α –≤―Ä―ä–Ζ–Κ–Η―²–Β –≤ –Φ―Ä–Β–Ε–Α―²–Α –Ω–Ψ-–¥–Ψ–±―Ä–Α –Ϋ–Α―΅–Α–Μ–Ϋ–Α ―²–Ψ―΅–Κ–Α, –Κ–Ψ–Β―²–Ψ –Ψ–Ω―²–Η–Φ–Η–Ζ–Η―Ä–Α –Ψ–±―É―΅–Β–Ϋ–Η–Β―²–Ψ ―ù –Ζ–Α ―Ä–Α–Ζ–Ω–Ψ–Ζ–Ϋ–Α–≤–Α–Ϋ–Β –Ϋ–Α –Β–Μ–Β–Φ–Β–Ϋ―²–Η –≤ –Κ–Α―Ä―²–Η–Ϋ–Η.

–€–Α―à–Η–Ϋ–Α―²–Α –Ϋ–Α –ë–Ψ–Μ―Ü–Φ–Α–Ϋ ―΅–Β―¹―²–Ψ ―¹–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –Κ–Α―²–Ψ ―΅–Α―¹―² –Ψ―² –Ω–Ψ-–≥–Ψ–Μ―è–Φ–Α –Φ―Ä–Β–Ε–Α. –ù–Α–Ω―Ä–Η–Φ–Β―Ä ―²―è –Φ–Ψ–Ε–Β –¥–Α ―¹–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –Ζ–Α –Ω―Ä–Β–Ω–Ψ―Ä―ä―΅–≤–Α–Ϋ–Β –Ϋ–Α ―³–Η–Μ–Φ–Η –Η–Μ–Η ―²–Β–Μ–Β–≤–Η–Ζ–Η–Ψ–Ϋ–Ϋ–Η ―¹–Β―Ä–Η–Α–Μ–Η –≤―ä–Ζ –Ψ―¹–Ϋ–Ψ–≤–Α –Ϋ–Α –Ω―Ä–Β–¥–Ω–Ψ―΅–Η―²–Α–Ϋ–Η―è―²–Α –Ϋ–Α –Ζ―Ä–Η―²–Β–Μ―è.

–€–Α―à–Η–Ϋ–Ϋ–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β - –¥–Ϋ–Β―¹ –Η ―É―²―Ä–Β

–ë–Μ–Α–≥–Ψ–¥–Α―Ä–Β–Ϋ–Η–Β –Ϋ–Α ―Ä–Α–±–Ψ―²–Α―²–Α ―¹–Η –Ψ―² 80-―²–Β –≥–Ψ–¥–Η–Ϋ–Η –Ϋ–Α –Φ–Η–Ϋ–Α–Μ–Η―è –≤–Β–Κ –Η ―¹–Μ–Β–¥ ―²–Ψ–≤–Α –î–Ε–Ψ–Ϋ –Ξ–Ψ–Ω―³–Β–Μ–¥ –Η –™–Β–Ψ―³―Ä–Η –Ξ–Η–Ϋ―²―ä–Ϋ ―¹–Α –Ω–Ψ–Φ–Ψ–≥–Ϋ–Α–Μ–Η –¥–Α ―¹–Β –Ω–Ψ–Μ–Ψ–Ε–Α―² –Ψ―¹–Ϋ–Ψ–≤–Η―²–Β –Ϋ–Α ―Ä–Β–≤–Ψ–Μ―é―Ü–Η―è―²–Α –≤ –Φ–Α―à–Η–Ϋ–Ϋ–Ψ―²–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β, –Κ–Ψ―è―²–Ψ –Ζ–Α–Ω–Ψ―΅–Ϋ–Α –Ψ–Κ–Ψ–Μ–Ψ 2010 –≥.

–†–Α–Ζ–≤–Η―²–Η–Β―²–Ψ, –Ϋ–Α –Κ–Ψ–Β―²–Ψ ―¹–Φ–Β ―¹–≤–Η–¥–Β―²–Β–Μ–Η ―¹–Β–≥–Α, ―¹―²–Α–Ϋ–Α –≤―ä–Ζ–Φ–Ψ–Ε–Ϋ–Ψ –±–Μ–Α–≥–Ψ–¥–Α―Ä–Β–Ϋ–Η–Β –Ϋ–Α –¥–Ψ―¹―²―ä–Ω–Α –¥–Ψ –Ψ–≥―Ä–Ψ–Φ–Ϋ–Η –Κ–Ψ–Μ–Η―΅–Β―¹―²–≤–Α –¥–Α–Ϋ–Ϋ–Η, –Κ–Ψ–Η―²–Ψ –Φ–Ψ–≥–Α―² –¥–Α ―¹–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α―² –Ζ–Α –Ψ–±―É―΅–Β–Ϋ–Η–Β –Ϋ–Α –Φ―Ä–Β–Ε–Η, –Η –Ϋ–Α –Ψ–≥―Ä–Ψ–Φ–Ϋ–Ψ―²–Ψ ―É–≤–Β–Μ–Η―΅–Β–Ϋ–Η–Β –Ϋ–Α –Κ–Ψ–Φ–Ω―é―²―ä―Ä–Ϋ–Α―²–Α –Φ–Ψ―â. –Γ―ä–≤―Ä–Β–Φ–Β–Ϋ–Ϋ–Η―²–Β –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Η –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Η –Φ―Ä–Β–Ε–Η ―΅–Β―¹―²–Ψ ―¹–Α –Ψ–≥―Ä–Ψ–Φ–Ϋ–Η –Η ―¹–Α –Η–Ζ–≥―Ä–Α–¥–Β–Ϋ–Η –Ψ―² –Φ–Ϋ–Ψ–≥–Ψ ―¹–Μ–Ψ–Β–≤–Β. –Δ–Β ―¹–Β –Ϋ–Α―Ä–Η―΅–Α―² –¥―ä–Μ–±–Ψ–Κ–Η –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Η –Φ―Ä–Β–Ε–Η, –Α –Ϋ–Α―΅–Η–Ϋ―ä―², –Ω–Ψ –Κ–Ψ–Ι―²–Ψ ―¹–Β –Ψ–±―É―΅–Α–≤–Α―², ―¹–Β –Ϋ–Α―Ä–Η―΅–Α –¥―ä–Μ–±–Ψ–Κ–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β.

–ï–¥–Η–Ϋ –±―ä―Ä–Ζ –Ω–Ψ–≥–Μ–Β–¥ –Κ―ä–Φ ―¹―²–Α―²–Η―è―²–Α –Ϋ–Α –Ξ–Ψ–Ω―³–Β–Μ–¥ –Ζ–Α –Α―¹–Ψ―Ü–Η–Α―²–Η–≤–Ϋ–Α―²–Α –Ω–Α–Φ–Β―² –Ψ―² 1982 –≥. –¥–Α–≤–Α –Η–Ζ–≤–Β―¹―²–Ϋ–Α –Ω–Β―Ä―¹–Ω–Β–Κ―²–Η–≤–Α –Ζ–Α ―²–Α–Ζ–Η ―Ä–Α–Ζ―Ä–Α–±–Ψ―²–Κ–Α. –£ –Ϋ–Β―è ―²–Ψ–Ι –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –Φ―Ä–Β–Ε–Α ―¹ 30 –≤―ä–Ζ–Β–Μ–Α. –ê–Κ–Ψ –≤―¹–Η―΅–Κ–Η –≤―ä–Ζ–Μ–Η ―¹–Α ―¹–≤―ä―Ä–Ζ–Α–Ϋ–Η –Ω–Ψ–Φ–Β–Ε–¥―É ―¹–Η, ―²–Β –Η–Φ–Α―² 435 –≤―Ä―ä–Ζ–Κ–Η. –£―ä–Ζ–Μ–Η―²–Β –Η–Φ–Α―² ―¹–≤–Ψ–Η ―¹―²–Ψ–Ι–Ϋ–Ψ―¹―²–Η, –≤―Ä―ä–Ζ–Κ–Η―²–Β –Η–Φ–Α―² ―Ä–Α–Ζ–Μ–Η―΅–Ϋ–Α ―¹–Η–Μ–Α –Η –Κ–Α―²–Ψ ―Ü―è–Μ–Ψ –Η–Φ–Α –Ω–Ψ-–Φ–Α–Μ–Κ–Ψ –Ψ―² 500 –Ω–Α―Ä–Α–Φ–Β―²―ä―Ä–Α, –Κ–Ψ–Η―²–Ψ ―²―Ä―è–±–≤–Α –¥–Α ―¹–Β ―¹–Μ–Β–¥―è―². –û–Ω–Η―²–Α–Μ –Β –Η –Φ―Ä–Β–Ε–Α ―¹―ä―¹ 100 –≤―ä–Ζ–Β–Μ–Α, –Ϋ–Ψ ―²–Ψ–≤–Α –Β –±–Η–Μ–Ψ ―²–≤―ä―Ä–¥–Β ―¹–Μ–Ψ–Ε–Ϋ–Ψ, –Ω―Ä–Β–¥–≤–Η–¥ –Κ–Ψ–Φ–Ω―é―²―ä―Ä–Α, –Κ–Ψ–Ι―²–Ψ –Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α–Μ –Ω–Ψ ―²–Ψ–≤–Α –≤―Ä–Β–Φ–Β. –€–Ψ–Ε–Β–Φ –¥–Α ―¹―Ä–Α–≤–Ϋ–Η–Φ ―²–Ψ–≤–Α ―¹ –≥–Ψ–Μ–Β–Φ–Η―²–Β –Β–Ζ–Η–Κ–Ψ–≤–Η –Φ–Ψ–¥–Β–Μ–Η –¥–Ϋ–Β―¹, –Κ–Ψ–Η―²–Ψ ―¹–Α –Η–Ζ–≥―Ä–Α–¥–Β–Ϋ–Η –Κ–Α―²–Ψ –Φ―Ä–Β–Ε–Η, –Κ–Ψ–Η―²–Ψ –Φ–Ψ–≥–Α―² –¥–Α ―¹―ä–¥―ä―Ä–Ε–Α―² –Ω–Ψ–≤–Β―΅–Β –Ψ―² –Β–¥–Η–Ϋ ―²―Ä–Η–Μ–Η–Ψ–Ϋ –Ω–Α―Ä–Α–Φ–Β―²―Ä–Η (–Β–¥–Η–Ϋ –Φ–Η–Μ–Η–Ψ–Ϋ –Φ–Η–Μ–Η–Ψ–Ϋ–Α).

–£ –Φ–Ψ–Φ–Β–Ϋ―²–Α –Φ–Ϋ–Ψ–≥–Ψ –Η–Ζ―¹–Μ–Β–¥–Ψ–≤–Α―²–Β–Μ–Η ―Ä–Α–Ζ―Ä–Α–±–Ψ―²–≤–Α―² –Ψ–±–Μ–Α―¹―²–Η―²–Β –Ϋ–Α –Ω―Ä–Η–Μ–Ψ–Ε–Β–Ϋ–Η–Β –Ϋ–Α –Φ–Α―à–Η–Ϋ–Ϋ–Ψ―²–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β. –ö–Ψ–Η –Ψ―² ―²―è―Ö ―â–Β –±―ä–¥–Α―² –Ϋ–Α–Ι-–Ε–Η–Ζ–Ϋ–Β―¹–Ω–Ψ―¹–Ψ–±–Ϋ–Η, –Ω―Ä–Β–¥―¹―²–Ψ–Η –¥–Α ―Ä–Α–Ζ–±–Β―Ä–Β–Φ, –Κ–Α―²–Ψ –≤ ―¹―ä―â–Ψ―²–Ψ –≤―Ä–Β–Φ–Β ―¹–Β –≤–Ψ–¥―è―² ―à–Η―Ä–Ψ–Κ–Ψ–Ψ–±―Ö–≤–Α―²–Ϋ–Η –¥–Η―¹–Κ―É―¹–Η–Η –Ω–Ψ –Β―²–Η―΅–Ϋ–Η―²–Β –≤―ä–Ω―Ä–Ψ―¹–Η, –Κ–Ψ–Η―²–Ψ ―¹―ä–Ω―ä―²―¹―²–≤–Α―² ―Ä–Α–Ζ―Ä–Α–±–Ψ―²–≤–Α–Ϋ–Β―²–Ψ –Η –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α–Ϋ–Β―²–Ψ –Ϋ–Α ―²–Α–Ζ–Η ―²–Β―Ö–Ϋ–Ψ–Μ–Ψ–≥–Η―è.

–Δ―ä–Ι –Κ–Α―²–Ψ ―³–Η–Ζ–Η–Κ–Α―²–Α –Β –¥–Ψ–Ω―Ä–Η–Ϋ–Β―¹–Μ–Α ―¹ –Η–Ϋ―¹―²―Ä―É–Φ–Β–Ϋ―²–Η –Ζ–Α ―Ä–Α–Ζ–≤–Η―²–Η–Β―²–Ψ –Ϋ–Α –Φ–Α―à–Η–Ϋ–Ϋ–Ψ―²–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β, –Η–Ϋ―²–Β―Ä–Β―¹–Ϋ–Ψ –Β –¥–Α ―¹–Β –≤–Η–¥–Η –Κ–Α–Κ ―³–Η–Ζ–Η–Κ–Α―²–Α, –Κ–Α―²–Ψ –Η–Ζ―¹–Μ–Β–¥–Ψ–≤–Α―²–Β–Μ―¹–Κ–Α –Ψ–±–Μ–Α―¹―², ―¹―ä―â–Ψ ―¹–Β –≤―ä–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –Ψ―² –Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Η―²–Β –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Η –Φ―Ä–Β–Ε–Η. –€–Α―à–Η–Ϋ–Ϋ–Ψ―²–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β –Ψ―²–¥–Α–≤–Ϋ–Α ―¹–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –≤ –Ψ–±–Μ–Α―¹―²–Η, –Κ–Ψ–Η―²–Ψ –Φ–Ψ–Ε–Β –±–Η ―¹–Α –Ϋ–Η –Ω–Ψ–Ζ–Ϋ–Α―²–Η –Ψ―² –Ω―Ä–Β–¥–Η―à–Ϋ–Η –ù–Ψ–±–Β–Μ–Ψ–≤–Η –Ϋ–Α–≥―Ä–Α–¥–Η –Ζ–Α ―³–Η–Ζ–Η–Κ–Α. –Γ―Ä–Β–¥ ―²―è―Ö –Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α–Ϋ–Β―²–Ψ –Ϋ–Α –Φ–Α―à–Η–Ϋ–Ϋ–Ψ –Ψ–±―É―΅–Β–Ϋ–Η–Β –Ζ–Α –Ω―Ä–Β―¹―è–≤–Α–Ϋ–Β –Η –Ψ–±―Ä–Α–±–Ψ―²–Κ–Α –Ϋ–Α –Ψ–≥―Ä–Ψ–Φ–Ϋ–Η―²–Β –Κ–Ψ–Μ–Η―΅–Β―¹―²–≤–Α –¥–Α–Ϋ–Ϋ–Η, –Ϋ–Β–Ψ–±―Ö–Ψ–¥–Η–Φ–Η –Ζ–Α –Ψ―²–Κ―Ä–Η–≤–Α–Ϋ–Β―²–Ψ –Ϋ–Α ―΅–Α―¹―²–Η―Ü–Α―²–Α –Ξ–Η–≥―¹. –î―Ä―É–≥–Η –Ω―Ä–Η–Μ–Ψ–Ε–Β–Ϋ–Η―è –≤–Κ–Μ―é―΅–≤–Α―² –Ϋ–Α–Φ–Α–Μ―è–≤–Α–Ϋ–Β –Ϋ–Α ―à―É–Φ–Α –Ω―Ä–Η –Η–Ζ–Φ–Β―Ä–≤–Α–Ϋ–Η―è―²–Α –Ϋ–Α –≥―Ä–Α–≤–Η―²–Α―Ü–Η–Ψ–Ϋ–Ϋ–Η―²–Β –≤―ä–Μ–Ϋ–Η –Ψ―² ―¹–±–Μ―ä―¹–Κ–≤–Α―â–Η ―¹–Β ―΅–Β―Ä–Ϋ–Η –¥―É–Ω–Κ–Η –Η–Μ–Η ―²―ä―Ä―¹–Β–Ϋ–Β―²–Ψ –Ϋ–Α –Β–Κ–Ζ–Ψ–Ω–Μ–Α–Ϋ–Β―²–Η.

–ü―Ä–Β–Ζ –Ω–Ψ―¹–Μ–Β–¥–Ϋ–Η―²–Β –≥–Ψ–¥–Η–Ϋ–Η ―²–Α–Ζ–Η ―²–Β―Ö–Ϋ–Ψ–Μ–Ψ–≥–Η―è –Ζ–Α–Ω–Ψ―΅–Ϋ–Α –¥–Α ―¹–Β –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α –Η –Ζ–Α –Η–Ζ―΅–Η―¹–Μ―è–≤–Α–Ϋ–Β –Η –Ω―Ä–Ψ–≥–Ϋ–Ψ–Ζ–Η―Ä–Α–Ϋ–Β –Ϋ–Α ―¹–≤–Ψ–Ι―¹―²–≤–Α―²–Α –Ϋ–Α –Φ–Ψ–Μ–Β–Κ―É–Μ–Η –Η –Φ–Α―²–Β―Ä–Η–Α–Μ–Η - –Ϋ–Α–Ω―Ä–Η–Φ–Β―Ä –Ζ–Α –Η–Ζ―΅–Η―¹–Μ―è–≤–Α–Ϋ–Β –Ϋ–Α ―¹―²―Ä―É–Κ―²―É―Ä–Α―²–Α –Ϋ–Α –±–Β–Μ―²―ä―΅–Ϋ–Η―²–Β –Φ–Ψ–Μ–Β–Κ―É–Μ–Η, –Κ–Ψ―è―²–Ψ –Ψ–Ω―Ä–Β–¥–Β–Μ―è ―²―è―Ö–Ϋ–Α―²–Α ―³―É–Ϋ–Κ―Ü–Η―è, –Η–Μ–Η –Ζ–Α –Ψ–Ω―Ä–Β–¥–Β–Μ―è–Ϋ–Β –Κ–Ψ–Η –Ϋ–Ψ–≤–Η –≤–Β―Ä―¹–Η–Η –Ϋ–Α –¥–Α–¥–Β–Ϋ –Φ–Α―²–Β―Ä–Η–Α–Μ –Φ–Ψ–≥–Α―² –¥–Α –Η–Φ–Α―² –Ϋ–Α–Ι-–¥–Ψ–±―Ä–Η―²–Β ―¹–≤–Ψ–Ι―¹―²–≤–Α –Ζ–Α –Η–Ζ–Ω–Ψ–Μ–Ζ–≤–Α–Ϋ–Β –≤ –Ω–Ψ-–Β―³–Β–Κ―²–Η–≤–Ϋ–Η ―¹–Μ―ä–Ϋ―΅–Β–≤–Η –Κ–Μ–Β―²–Κ–Η.

–‰–Ζ―²–Ψ―΅–Ϋ–Η–Κ:¬†The Nobel Prize in Physics 2024

Science Editors: Ulf Danielsson, Olle Eriksson, Anders IrbΟΛck, and Ellen Moons, the Nobel Committee for Physics

Text: Anna Davour

Translator: Clare Barnes

Illustrations: Johan Jarnestad

Editor: Sara Gustavsson

© The Royal Swedish Academy of Sciences

–û―â–Β –Ω–Ψ ―²–Β–Φ–Α―²–Α

–Λ–Η–Ζ–Η–Κ–Α

–ù–Ψ–±–Β–Μ–Ψ–≤–Α―²–Α –Ϋ–Α–≥―Ä–Α–¥–Α –Ζ–Α ―³–Η–Ζ–Η–Κ–Α –Ζ–Α 2024 –≥. –Β –Ζ–Α ―Ä–Α–Ζ–≤–Η―²–Η–Β―²–Ψ –Ϋ–Α "–Η–Ζ–Κ―É―¹―²–≤–Β–Ϋ–Η―è –Η–Ϋ―²–Β–Μ–Β–Κ―²" (–≤–Η–¥–Β–Ψ)

–Λ–Η–Ζ–Η–Κ–Α

–ù–Ψ–±–Β–Μ–Ψ–≤–Η―²–Β –Ϋ–Α–≥―Ä–Α–¥–Η –Ψ―²–≤―ä―²―Ä–Β: –ö–Α–Κ ―¹–Β –Ω―Ä–Η―¹―ä–Ε–¥–Α –Ϋ–Α–Ι-–≥–Ψ–Μ―è–Φ–Α―²–Α –Ϋ–Α–≥―Ä–Α–¥–Α –Ζ–Α ―³–Η–Ζ–Η–Κ–Α

–Δ–Β―Ö–Ϋ–Ψ–Μ–Ψ–≥–Η–Η

–ö–Α–Κ ―Ä–Α–±–Ψ―²–Η –¥―ä–Μ–±–Ψ–Κ–Ψ―²–Ψ ―¹–Α–Φ–Ψ–Ψ–±―É―΅–Β–Ϋ–Η–Β –Ϋ–Α –Ϋ–Β–≤―Ä–Ψ–Ϋ–Ϋ–Η―²–Β –Φ―Ä–Β–Ε–Η?

–ö–Ψ–Φ–Β–Ϋ―²–Α―Ä–Η

–€–Ψ–Μ―è, ―Ä–Β–≥–Η―¹―²―Ä–Η―Ä–Α–Ι―²–Β ―¹–Β –Ψ―² T–Θ–ö!

–ê–Κ–Ψ –≤–Β―΅–Β –Η–Φ–Α―²–Β ―Ä–Β–≥–Η―¹―²―Ä–Α―Ü–Η―è, –Ϋ–Α―²–Η―¹–Ϋ–Β―²–Β –Δ–Θ–ö!

–ù―è–Φ–Α –Κ–Ψ–Φ–Β–Ϋ―²–Α―Ä–Η –Κ―ä–Φ ―²–Α–Ζ–Η –Ϋ–Ψ–≤–Η–Ϋ–Α !

–ü–Ψ―¹–Μ–Β–¥–Ϋ–Η –Κ–Ψ–Φ–Β–Ϋ―²–Α―Ä–Η

YKoshev

–ü―Ä–Β―¹―²–Η–Ε–Ϋ–Α –Ϋ–Α–≥―Ä–Α–¥–Α –Ψ―² –ë–ê–ù ―¹–Ω–Β―΅–Β–Μ–Η –≥–Μ–Α–≤–Ϋ–Η―è―² ―Ä–Β–¥–Α–Κ―²–Ψ―Ä –Ϋ–Α –ù–Α―É–Κ–ΑOFFNews

Johnny B Goode

–ü―Ä–Β―¹―²–Η–Ε–Ϋ–Α –Ϋ–Α–≥―Ä–Α–¥–Α –Ψ―² –ë–ê–ù ―¹–Ω–Β―΅–Β–Μ–Η –≥–Μ–Α–≤–Ϋ–Η―è―² ―Ä–Β–¥–Α–Κ―²–Ψ―Ä –Ϋ–Α –ù–Α―É–Κ–ΑOFFNews

Gunteer

–ü―Ä–Β―¹―²–Η–Ε–Ϋ–Α –Ϋ–Α–≥―Ä–Α–¥–Α –Ψ―² –ë–ê–ù ―¹–Ω–Β―΅–Β–Μ–Η –≥–Μ–Α–≤–Ϋ–Η―è―² ―Ä–Β–¥–Α–Κ―²–Ψ―Ä –Ϋ–Α –ù–Α―É–Κ–ΑOFFNews

–Ξ―Ä–Η―¹―²–Η―è–Ϋ–Η–Ϋ

–Δ–Ψ–≤–Α –Β –Κ―Ä–Α–Μ―è―² –Ϋ–Α ―²–Η–Κ–≤–Η―²–Β: –Δ–Η–Κ–≤–Α―²–Α –Φ―É ―²–Β–Ε–Η –Ϋ–Α–¥ –Β–¥–Η–Ϋ –Β–¥–Η–Ϋ ―²–Ψ–Ϋ